EU AI Act ab August 2026: Hochrisiko-KI-Systeme — der Compliance-Countdown

Am 2. August 2026 treten die vollständigen Anforderungen des EU AI Act für Hochrisiko-KI-Systeme in Kraft. Unternehmen, die KI-Systeme in Bereichen wie Personalmanagement, Kreditvergabe, Versicherungswesen oder kritischer Infrastruktur einsetzen, müssen ab diesem Datum nachweisen, dass ihre Systeme die Anforderungen an Risikomanagement, Datenqualität, Transparenz und menschliche Aufsicht erfüllen.

Dieser Artikel ist der letzte Compliance-Check: Was muss bis August 2026 stehen, was sind die häufigsten Lücken und welche Sanktionen drohen bei Nichteinhaltung?

Was ändert sich am 2. August 2026?

Der EU AI Act trat am 1. August 2024 in Kraft und wird stufenweise anwendbar. Am 2. August 2026 greift die letzte große Stufe: Alle Anforderungen für Hochrisiko-KI-Systeme gemäß Anhang III werden vollständig durchsetzbar. Das BSI wird als nationale Marktüberwachungsbehörde fungieren und Bußgelder verhängen können.

Betroffen sind KI-Systeme in diesen Bereichen:

- Personalmanagement: KI für Bewerbungsscreening, Leistungsbewertung, Beförderungsentscheidungen

- Kreditvergabe und Versicherung: Scoring-Modelle, automatisierte Risikobewertung, Preisgestaltung

- Kritische Infrastruktur: KI-gesteuerte Steuerungssysteme in Energie, Wasser, Verkehr

- Bildung und Berufsausbildung: Automatisierte Bewertungssysteme, Zulassungsentscheidungen

- Strafverfolgung: Prädiktive Polizeiarbeit, Gesichtserkennung (strenge Einschränkungen)

- Biometrische Identifizierung: Ferngesteuerte biometrische Identifizierung in Echtzeit

Die 6 Pflichten für Anbieter von Hochrisiko-KI

- Risikomanagementsystem: Dokumentiertes System zur Identifikation, Bewertung und Minderung von Risiken während des gesamten Lebenszyklus des KI-Systems.

- Daten-Governance: Anforderungen an Trainingsdaten: Relevanz, Repräsentativität, Fehlerfreiheit, Vollständigkeit. Bias-Prüfung und Dokumentation der Datenherkunft.

- Technische Dokumentation: Vollständige Dokumentation von Design, Funktionsweise, Leistungskennzahlen, Einschränkungen und vorgesehener Verwendung. Muss vor Inverkehrbringen vorliegen.

- Protokollierung: Automatische Aufzeichnung von Eingaben, Ausgaben und Entscheidungen des Systems. Logs müssen für die Aufsichtsbehörde zugänglich sein.

- Transparenz und Nutzerinformation: Klare Kennzeichnung als KI-System. Gebrauchsanweisung mit Funktionsweise, Einschränkungen und Risiken.

- Menschliche Aufsicht: Maßnahmen, die es Menschen ermöglichen, das KI-System zu verstehen, zu überwachen und bei Bedarf einzugreifen oder abzuschalten.

Compliance-Check: Wo stehen Sie?

- ☐ KI-Inventar erstellt: Alle KI-Systeme im Unternehmen erfasst und nach Risikoklasse kategorisiert

- ☐ Hochrisiko-Systeme identifiziert: Systeme gemäß Anhang III klassifiziert

- ☐ Risikomanagementsystem implementiert: Dokumentiert, lebendig, regelmäßig aktualisiert

- ☐ Daten-Governance: Trainingsdaten dokumentiert, Bias-Prüfung durchgeführt

- ☐ Technische Dokumentation: Vollständig, aktuell, zugänglich

- ☐ Logging aktiviert: Automatische Protokollierung aller Entscheidungen

- ☐ Human Oversight: Mechanismen für menschliche Aufsicht und Override definiert

- ☐ Konformitätsbewertung: Durchgeführt (Selbstbewertung oder Drittprüfung je nach Risikoklasse)

- ☐ EU-Konformitätserklärung: Erstellt und unterzeichnet

- ☐ CE-Kennzeichnung: Angebracht (wo zutreffend)

Sanktionen bei Nichteinhaltung

Der EU AI Act sieht gestaffelte Bußgelder vor:

- Verbotene KI-Praktiken: Bis zu 35 Mio. Euro oder 7% des weltweiten Jahresumsatzes

- Hochrisiko-Anforderungen: Bis zu 15 Mio. Euro oder 3% des Umsatzes

- Falsche Angaben gegenüber Behörden: Bis zu 7,5 Mio. Euro oder 1% des Umsatzes

Für KMU und Start-ups gelten reduzierte Obergrenzen. Das BSI wird in Deutschland die Durchsetzung übernehmen und hat angekündigt, ab August 2026 aktiv zu prüfen.

Häufig gestellte Fragen zum AI Act August 2026

Was passiert, wenn wir bis August 2026 nicht compliant sind?

Das BSI kann Bußgelder verhängen, den Betrieb des KI-Systems untersagen oder einen Rückruf anordnen. In der Praxis ist eine sofortige Durchsetzungswelle unwahrscheinlich, aber Unternehmen sollten zumindest ein dokumentiertes Compliance-Programm nachweisen können, das den Weg zur vollständigen Konformität zeigt.

Sind alle KI-Systeme betroffen?

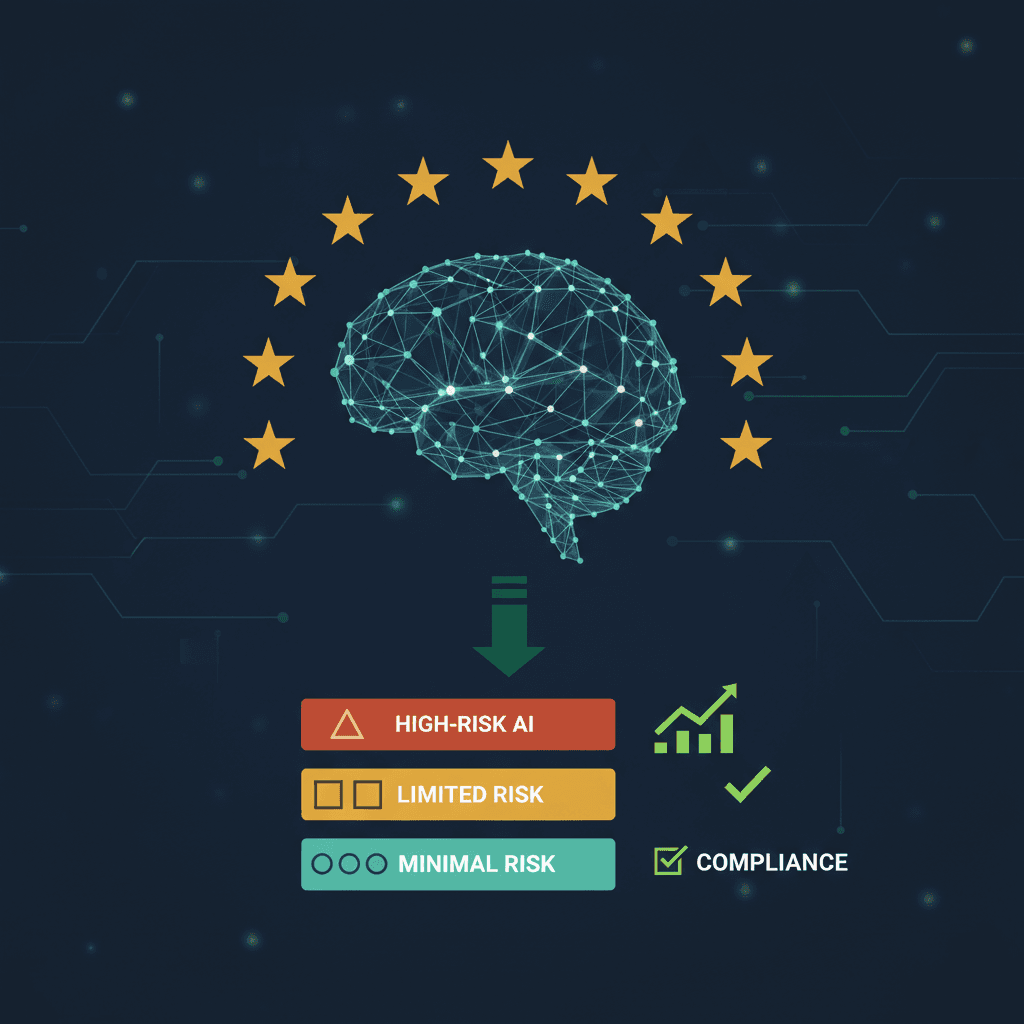

Nein. Der AI Act klassifiziert KI-Systeme in vier Risikoklassen: verboten, Hochrisiko, begrenzt und minimal. Die strengen Anforderungen gelten nur für Hochrisiko-Systeme (Anhang III). Allgemeine Chatbots, einfache Automatisierungen und KI für interne Analysen fallen meist unter "begrenzt" oder "minimal" mit deutlich geringeren Anforderungen.

Brauchen wir eine externe Konformitätsbewertung?

Für die meisten Hochrisiko-KI-Systeme reicht eine Selbstbewertung (Anhang VI). Eine externe Konformitätsbewertung durch eine notifizierte Stelle ist nur für bestimmte Systeme in den Bereichen biometrische Identifizierung und kritische Infrastruktur vorgeschrieben. Im Zweifelsfall ist eine externe Bewertung dennoch empfehlenswert, um regulatorische Sicherheit zu gewinnen.

Gilt der AI Act auch für KI-Systeme, die vor August 2024 im Einsatz waren?

Ja, mit Übergangsfristen. Bestehende Hochrisiko-KI-Systeme, die vor dem 2. August 2025 in Verkehr gebracht wurden, müssen bis zum 2. August 2027 die Anforderungen erfüllen — sofern sie nicht wesentlich geändert werden. Bei wesentlichen Änderungen gilt die Pflicht sofort.

Weitere relevante Beiträge

EU AI Act: High-Risk AI Systems — The Complete Compliance Guide

The EU AI Act’s high-risk obligations are now in effect. This guide covers which AI systems are classified as high-risk, the six compliance requirements (risk management, data governance, documentation, logging, transparency, human oversight), conformity assessment, penalties, and a practical implementation roadmap.

AI‑Modell‑Governance im Alltag: Wie MaRisk, EBA, EGIM und BCBS 239 den AI‑Act für Hochrisiko‑AI vorstrukturieren

Banken verfügen mit MaRisk, EBA‑Guidelines, EGIM und BCBS 239 bereits über ein robustes Fundament für Modell‑ und Daten‑Governance. Der EU-AI-Act baut auf diesen Strukturen auf und ergänzt sie gezielt um AI‑spezifische Anforderungen für Hochrisiko‑AI‑Systeme, insbesondere im Kreditscoring natürlicher Personen. Anstatt eine parallele „AI‑Governance‑Welt“ aufzubauen, können Institute Hochrisiko‑AI in ihr bestehendes Modell‑Framework integrieren und dieses risikobasiert erweitern.Konkret heißt das: Modellinventar, Rollen, Validierung und Gremienstrukturen aus MaRisk/EBA/EGIM lassen sich nutzen, um AI‑Act‑Kontrollen wie lebenszyklusbezogenes Risikomanagement, Human‑Oversight‑Konzepte sowie technische Dokumentation und Logging zu verankern. BCBS‑239‑orientierte Datenarchitekturen bilden die Basis für AI‑Trainings‑, Validierungs‑ und Testdaten; neu hinzu kommen Fairness‑ und Bias‑Analysen sowie Grundrechts‑ und Diskriminierungsbewertungen.Der AI-Act ist damit weder ein kompletter Neustart noch ein reines „Paperwork‑Upgrade“. Er verlangt zusätzliche inhaltliche Fähigkeiten – etwa bei Datenethik, Fairness‑Messung und technischer Dokumentation – lässt sich aber effizient im bestehenden Governance‑Rahmen verorten. Ein pragmatisches Zielbild lautet daher: ein gemeinsames Framework für alle Modelle, risikobasiert erweitert für Hochrisiko‑AI.

AI Model Governance in Financial Services: How MaRisk, EBA, and BCBS 239 Pre-Structure AI Act Compliance

Financial institutions already have model governance frameworks from MaRisk, EBA EGIM, and BCBS 239 that map directly to EU AI Act requirements. This guide shows exactly how to extend existing regulatory infrastructure for comprehensive AI governance — without building from scratch.