KI und MaRisk: Was Institute jetzt konkret umsetzen müssen

Regulatorik · Modellrisikomanagement · KI-Governance

KI und MaRisk gehören heute untrennbar zusammen – nicht, weil neue Spezialregeln geschaffen wurden, sondern weil bestehende Anforderungen konsequent auch auf automatisierte Modelle und KI angewendet werden müssen. Genau hier liegt die eigentliche Herausforderung: Viele Institute haben KI bereits im Einsatz, aber häufig außerhalb etablierter Governance- und Modellrisikostrukturen.

Der Entwurf der MaRisk-Novelle 2026 (BaFin-Konsultation) macht deutlich, dass es keinen regulatorischen Sonderstatus für KI gibt. Stattdessen gilt ein weiter Modellbegriff: Jedes KI-System, das Entscheidungen unterstützt oder automatisiert trifft, unterliegt denselben Anforderungen wie konventionelle Modelle. Für die Praxis ist entscheidend, dass diese Systeme explizit, nachvollziehbar und prüfbar in bestehende Strukturen integriert werden.

Die folgenden Handlungsfelder zeigen, wo Institute konkret ansetzen sollten – und wo in der Praxis die größten Risiken entstehen.

1.Vollständige Inventarisierung als Ausgangspunkt

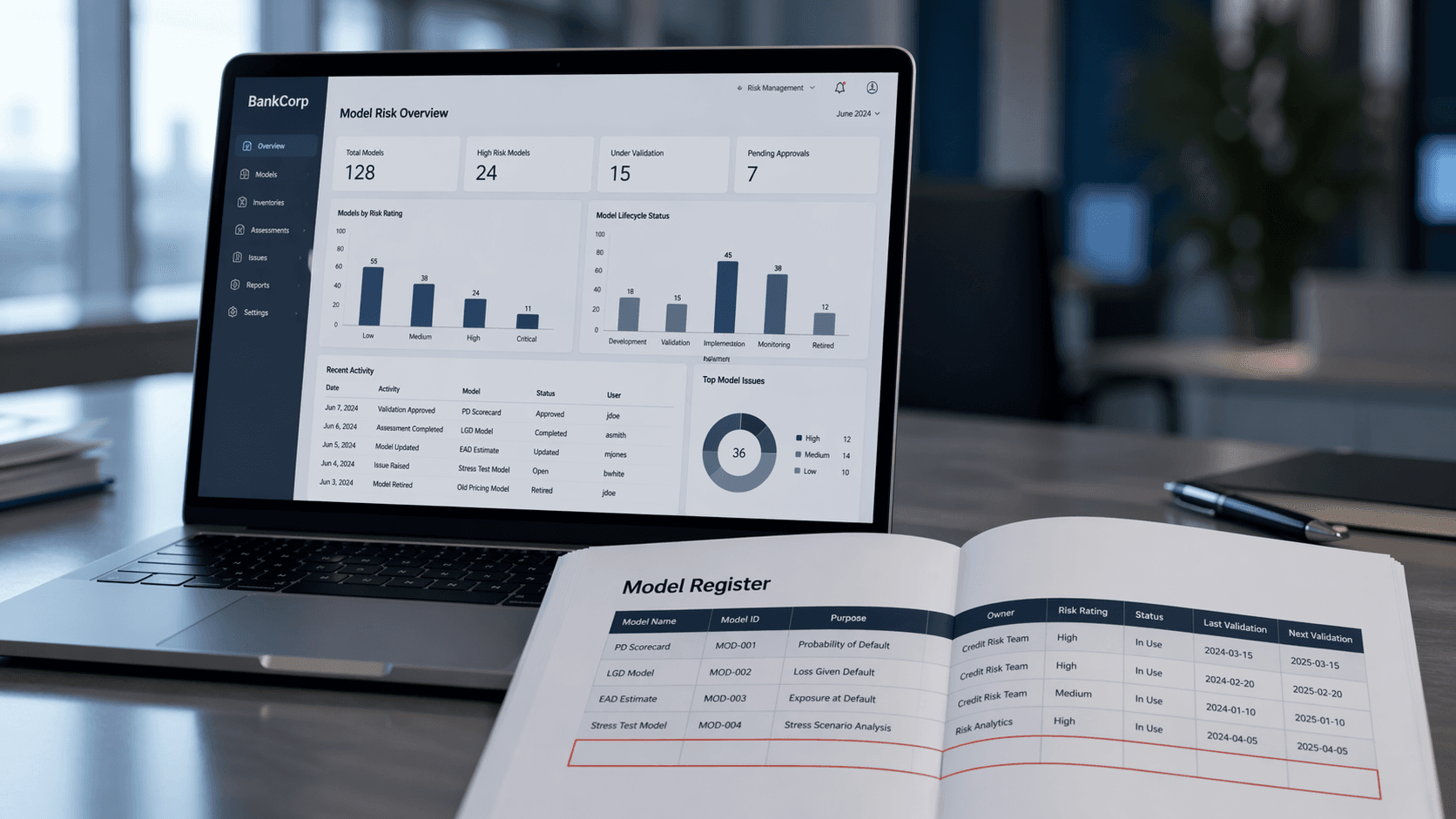

Wer KI nicht vollständig inventarisiert, kann sie nicht steuern. Die MaRisk verlangt ein belastbares Modellregister, das alle KI-Systeme erfasst – unabhängig davon, ob sie intern entwickelt oder extern zugekauft wurden. Fehlen Einträge, fehlt die Grundlage für jedes weitere Governance-Element.

Ein häufig unterschätztes Problem ist bereits der erste Schritt: Viele Institute wissen nicht vollständig, welche Modelle tatsächlich im Einsatz sind. Eine belastbare Inventarisierung umfasst mehr als nur die klassischen Risikomodelle. Alle Kategorien müssen abgedeckt sein:

- Modelle für produktive Entscheidungssysteme im Kreditprozess

- Unterstützende KI wie z. B. Frühwarnsysteme oder Scoring-Assistenten

- Externe Modelle und zugekaufte KI-Lösungen von Drittanbietern

Gerade bei KI entstehen Risiken oft dort, wo Fachbereiche eigenständig Lösungen implementieren – häufig ohne Einbindung von IT-Governance oder Risikomanagement. Diese sogenannten Schattenmodelle entziehen sich der Governance und werden in Prüfungen regelmäßig beanstandet.

Konkrete Maßnahme

Ein zentrales Modellregister ist Pflicht. Es muss verpflichtend alle Modelle einschließlich KI erfassen – mit Angabe von Zweck, Risikoeinstufung, Eigentümer und Validierungsstatus. Ohne diese Transparenz ist kein wirksames Modellrisikomanagement möglich.

2. Risikoorientiertes Rahmenwerk statt Standardprozesse

Nicht jede KI-Anwendung benötigt dieselbe Kontrolltiefe – aber jede braucht ein klar definiertes Rahmenwerk. Die MaRisk fordert eine risikoorientierte Ausgestaltung: Umso kritischer das Modell, desto engmaschiger müssen Validierung, Monitoring und Eskalation ausgestaltet sein.

Die MaRisk verlangt eine risikoorientierte Ausgestaltung entlang von Validierung, laufendem Monitoring, Drift-Erkennung, Change-Management und Datenqualitätskontrollen. Nachfolgende Tabelle gibt beispielhaft einen Überblick, wie man ein abgestuftes Kontrollsystem gestalten könnte:

Ein zentraler Punkt für KI-Modelle ist die Modell-Drift. KI-Systeme reagieren typischerweise sensibel auf Veränderungen im Input oder in den Umfeldbedingungen. Ohne systematische Überwachung kann die Output-Qualität schleichend sinken – ohne dass dies sofort sichtbar wird.

Strategisches Risiko

Institute unterschätzen häufig die Geschwindigkeit, mit der sich KI-Modelle entkoppeln können. Das führt zu falschen Entscheidungen, ohne dass dies sofort auffällt – und ohne dass eine nachvollziehbare Eskalationskette ausgelöst wird.

Konkrete Maßnahme

Ein abgestuftes Kontrollsystem, das Komplexität und Risikorelevanz berücksichtigt, ist zwingend erforderlich. Hochkritische KI-Systeme benötigen engmaschiges Monitoring und klar definierte Eskalationsprozesse.

3. Erklärbarkeit nicht nur als Pflichtübung

Erklärbarkeit ist keine reine Compliance-Anforderung, sondern Steuerungsvoraussetzung: Wer nicht nachvollziehen kann, warum ein Modell einen bestimmten Output erzeugt, kann das Modell nicht verantwortlich betreiben. Die

Erklärbarkeit entscheidet darüber, ob ein Institut seine Modelle tatsächlich steuern kann. Die zentrale Frage: Wenn ein Modell einen Output erzeugt – warum wurde gerade dieser Output erzeugt?

Gerade bei komplexen KI-Verfahren ist diese Frage schwer zu beantworten. Dennoch ist sie unverzichtbar:

- Ohne Erklärbarkeit ist keine fundierte Validierung möglich

- Ohne Verständnis können Risiken nicht bewertet werden

- Ohne Transparenz ist keine verantwortliche Entscheidung möglich

Praxisproblem

Viele Institute versuchen, Erklärbarkeit nachträglich hinzuzufügen. Das ist strukturell schwierig und in der Regel nicht ausreichend – Prüfer erkennen den Unterschied zwischen echter und dokumentierter Erklärbarkeit.

Konkrete Maßnahme

Erklärbarkeit muss bereits bei der Modellauswahl berücksichtigt werden. Zusätzlich braucht es klare Grenzen: Welche Einflussfaktoren sind entscheidungsrelevant? In welchen Fällen ist KI strukturell nicht geeignet? Wann ist eine manuelle Überprüfung erforderlich?

4. Governance: Klare Verantwortung statt impliziter Zuständigkeiten

Die MaRisk lässt keine Interpretationsspielräume: Die Verantwortung für KI-Modelle verbleibt vollständig beim Institut. Das erfordert eindeutige Rollenzuweisungen mit funktionaler Trennung – auch und gerade bei extern entwickelten Modellen.

Ein häufiger Schwachpunkt in der Praxis ist die unklare Verteilung von Verantwortung. Die MaRisk fordert eindeutige Rollen für Entwicklung, Validierung und Betrieb sowie klare Berichtslinien an die relevanten Gremien. Nachfolgende Tabelle zeigt eine praxisbewährte Rollenstruktur:

Besonders kritisch ist der Einsatz externer KI-Modelle. Hier entsteht regelmäßig eine gefährliche Wissenslücke zwischen der Nutzung eines Modells und dem tatsächlichen Verständnis seiner Funktionsweise.

Strategisches Risiko

Wenn ein Institut ein Modell nicht versteht, kann es dessen Risiken nicht steuern – unabhängig davon, ob es intern oder extern entwickelt wurde. "Black Box durch Outsourcing" ist regulatorisch nicht akzeptabel.

Konkrete Maßnahme

Auch bei Nutzung von Drittanbietern muss intern ausreichend Know-how aufgebaut werden, um Modellannahmen kritisch bewerten zu können. Eine externe Validierung ersetzt nicht das eigene Verständnis.

5. Internes Modellverständnis als Pflicht

Die MaRisk fordert eindeutig, dass Institute die Funktionsweise und Risiken ihrer KI-Systeme verstehen – nicht nur dokumentieren. Das schließt externe Modelle ausdrücklich ein. Anbieter-Dokumentation allein reicht dafür nicht aus.

Das interne Verständnis von Modellen und KI ist ein besonders kritischer Punkt. Die Anforderung betrifft insbesondere die zugrunde liegenden Annahmen, die verwendeten Trainingsdaten sowie die Grenzen und bekannten Schwächen des KI-Systems.

Praxisproblem

Viele Institute verlassen sich bei externen KI-Lösungen auf Anbieter-Dokumentation. Diese ist jedoch selten ausreichend für eine echte Risikobewertung – Herstellerangaben sind kein Ersatz für unabhängige Validierung.

Strategisches Risiko

Fehlendes Verständnis führt zum Blindflug – insbesondere in Stresssituationen oder bei Modellversagen. Genau in diesen Momenten versagen Institute, die sich ausschließlich auf externe Dokumentation gestützt haben.

Konkrete Maßnahme

Der Aufbau interner Expertise ist unverzichtbar: Schulungen für Fachbereiche und Risikomanagement, unabhängige Validierung auch externer Modelle und eine kritische Prüfung der Anbieterannahmen.

6. Integration entscheidet über Erfolg und Risiko

Die regulatorische Erwartung ist eindeutig: KI und MaRisk müssen konsequent zusammen gedacht werden. Die Herausforderung liegt nicht in neuen Regeln, sondern in der sauberen Umsetzung bestehender Prinzipien.

Die größten Risiken entstehen dort, wo Modelle nicht vollständig erfasst sind, Governance-Strukturen umgangen werden, Erklärbarkeit fehlt und Verantwortung unklar bleibt. Institute, die diese Punkte strukturiert angehen, schaffen nicht nur regulatorische Sicherheit – sie verbessern auch messbar ihre Entscheidungsqualität.

Weiterführende regulatorische Grundlagen: MaRisk-Seite der BaFin · ECB Guide to internal models

Ist Ihre KI-Landschaft MaRisk-ready?

Viele Institute stellen in ersten Gesprächen fest, dass einzelne Modelle oder ganze Kategorien außerhalb der etablierten Governance laufen. Ein strukturierter Review schafft hier in kurzer Zeit Klarheit.

ADVISORI FTC begleitet Sie von der Inventarisierung über das Governance-Design bis zur prüfungssicheren Validierung – mit direktem Bezug zur MaRisk-Novelle 2026.

Sprechen Sie uns an: Schildern Sie kurz Ihren konkreten Handlungsbedarf – wir melden uns innerhalb von 24 Stunden mit einer ersten Einschätzung.

7. Häufig gestellte Fragen (FAQ)

Ab wann gilt ein KI-System als Modell im Sinne der MaRisk?

Die MaRisk legt einen weiten Modellbegriff zugrunde: Jedes System, das auf Basis von Daten und Algorithmen Entscheidungen unterstützt oder automatisiert trifft, fällt darunter – unabhängig von der technischen Implementierung. Dies gilt für klassische Scoring-Modelle ebenso wie für neuronale Netze oder Large Language Models, sofern sie in regulierten Prozessen eingesetzt werden.

Was ist unter Modell-Drift zu verstehen und wie wird sie erkannt?

Modell-Drift bezeichnet die schleichende Verschlechterung der Modellqualität durch veränderte Input-Daten oder Umfeldbedingungen. Erkannt wird sie durch kontinuierliches Monitoring von Performance-Metriken (z. B. Gini-Koeffizient, PSI), automatisierte Alerting-Systeme und regelmäßige Backtesting-Läufe. Die Häufigkeit richtet sich nach der Risikokategorie des Modells.

Was genau verlangt die MaRisk bei externen KI-Lösungen?

Die MaRisk überträgt die volle Verantwortung für das Modell auf das Institut – auch wenn Entwicklung und Betrieb ausgelagert sind. Das bedeutet: Das Institut muss die Funktionsweise des Modells verstehen, eine unabhängige Validierung sicherstellen und dokumentieren können, wie Risiken gesteuert werden. Anbieter-Dokumentation allein erfüllt diese Anforderungen nicht.

Welche Konsequenzen hat eine fehlende Autorenbox oder unklare Governance in Prüfungen?

In Prüfungen durch Interne Revision oder externe Prüfer führen unklare Verantwortlichkeiten regelmäßig zu Findings der Kategorie Wesentlich oder Kritisch. Fehlende Dokumentation gilt als Indikator für mangelnde Governance – unabhängig davon, ob das Modell selbst korrekt funktioniert.

Muss für jedes KI-Modell eine vollständige Validierung durchgeführt werden?

Nein – die MaRisk fordert eine risikoorientierte Ausgestaltung. Hochkritische Modelle benötigen eine Vollvalidierung mit externer Beteiligung, weniger kritische Systeme können mit einer Plausibilitätsprüfung auskommen. Entscheidend ist, dass die Risikoeinstufung und der daraus abgeleitete Kontrollumfang nachvollziehbar dokumentiert sind.

Senior Consultant Risk Management , ADVISORI FTC GmbH

Über den Autor

Helge Thiele absolvierte sein Studium der Mathematik an der Universität Leipzig. Im Rahmen seiner 17-jährigen Beratungserfahrung beschäftigte er sich hauptsächlich mit Risikomanagement in Banken, Methodik im Kredit- und Marktrisiko, IFRS 9, Stresstest, Datenaufbereitung, Prozessverbesserungen, Datenanalyse und Bankenaufsichtsrecht, insbesondere MaRisk, RTF-Leitfaden, Basel III / IV, CRD VI / CRR III.

Durch umfangreiche Erfahrung aus diversen Anpassungs- und Neuentwicklungsprojekten weist er IT-Kenntnisse und aktuelles Wissen in methodischen und bankfachlichen Themen sowie der einhergehenden regulatorischen Rahmenbedingungen auf. Damit ist er ein geschätzter Vermittler zwischen den Abteilungen. Seine Fähigkeiten als Fachexperte werden durch seine Arbeitserfahrung hinsichtlich IT-Spezifikation und Dokumentation und seine fachliche Testerfahrung ergänzt.

Weitere relevante Beiträge

Vertiefen Sie Ihr Wissen mit ausgewählten Artikeln aus der gleichen Themenwelt.

Generative KI im Unternehmen: Vom Pilot zum produktiven Enterprise-Rollout

Generative KI produktiv einführen: die drei Deployment-Muster (Copilot, RAG, Fine-Tuning), fünf Use-Case-Archetypen, Compliance nach EU AI Act und OWASP LLM Top 10, realistische Kosten-Mathematik und das Betriebsmodell, an dem die meisten Pilotprojekte scheitern.

Welche 4 Arten von KI gibt es? Der vollständige Leitfaden

Die 4 Arten künstlicher Intelligenz nach Arend Hintze (2016): Reaktive Maschinen, Limited Memory, Theory of Mind und selbstbewusste KI. Mit Beispielen, Einordnung im EU AI Act und Bezug zum heutigen Unternehmenseinsatz.

KI-Roadmap entwickeln: Die 4-Phasen-Methode für Enterprise AI-Transformation

Eine KI-Roadmap in vier Phasen: Potenzial-Assessment, Use-Case-Auswahl, Pilot und Skalierung. Mit Zeitplan 12-18 Monate, Scoring-Matrix, Pitfall-Taxonomie, EU-AI-Act- und ISO-42001-Einbettung sowie einer FAQ für Entscheider.