EU AI-Act im Finanzsektor: AI im bestehenden IKS verankern – statt einer Parallelwelt aufzubauen

Warum der AI-Act für Banken vor allem eine AI‑spezifische Erweiterung des internen Kontrollsystems ist – und kein kompletter Governance‑Neustart.

Kernaussagen:

- Der EU AI-Act verlangt von Banken keine neuen Grundstrukturen der Unternehmenssteuerung, sondern die AI-spezifische Nutzung und Erweiterung des bestehenden internen Kontrollsystems (IKS) für AI-Systeme, insbesondere bei Hochrisiko-AI.

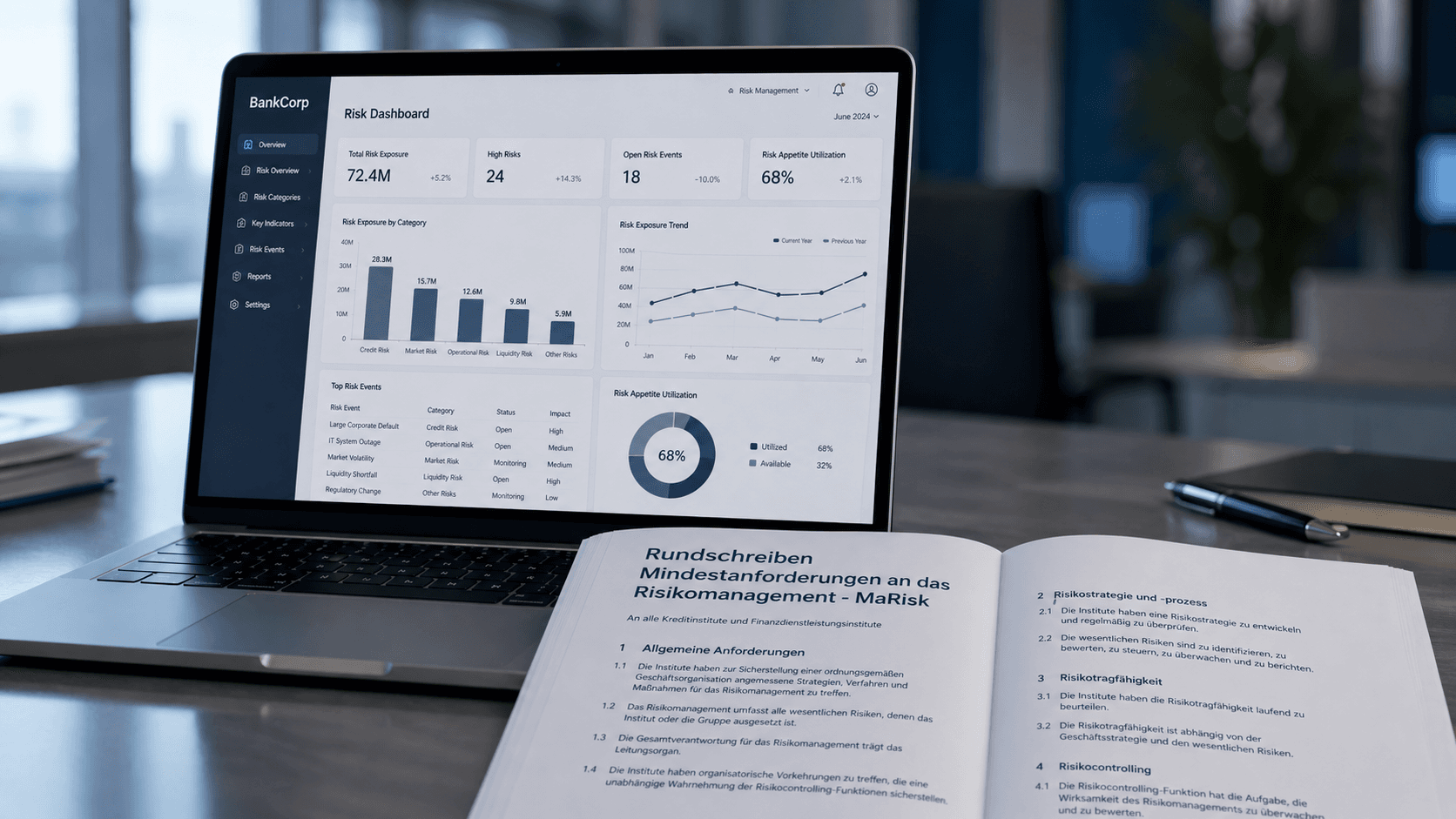

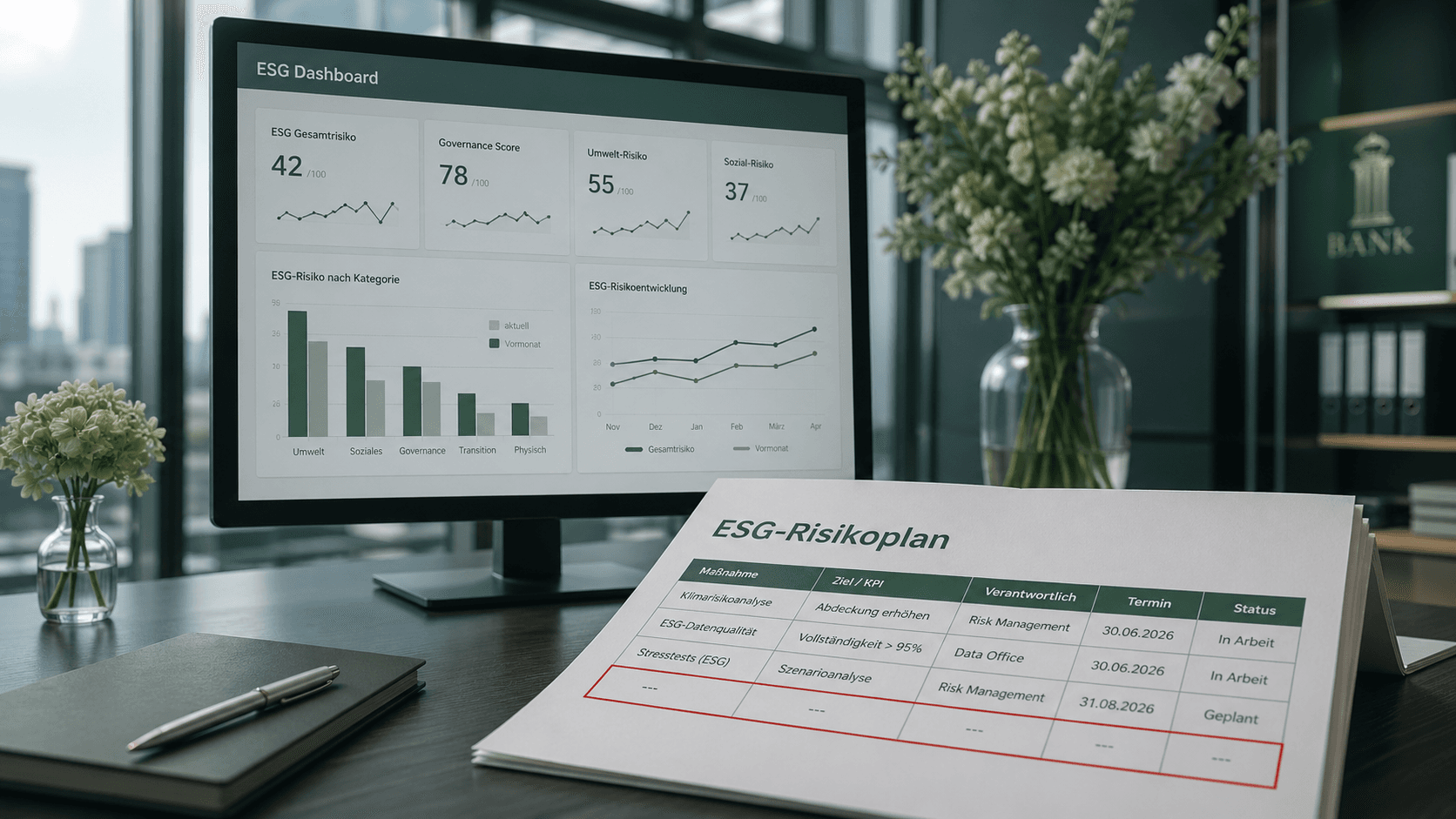

- Qualitätsmanagement, Risikomanagement und Kontrollfunktionen nach dem AI-Act lassen sich in die etablierte IKS-Architektur von Banken einordnen (MaRisk, EBA-Guidelines), statt eine parallele Kontrollwelt aufzubauen.

- Der wesentliche Anpassungsbedarf liegt in der inhaltlichen Ergänzung der bestehenden Governance, Risiko und Kontrollprozesse um AI-spezifische Anforderungen – nicht im Aufbau eines vollständig neuen Kontrollsystems.

Der vermeintliche Umbruch: Warum der AI-Act Banken weniger überrascht als gedacht

Mit dem EU AI-Act entsteht erstmals ein einheitlicher europäischer Rechtsrahmen für den Einsatz von AI. In vielen Banken wird dieser Schritt zunächst als tiefgreifender Einschnitt wahrgenommen – vor allem dort, wo AI bislang eher als Innovationsthema oder IT‑Projekt gesehen wurde. Der Regelungsumfang des AI-Act reicht zwar weit über reine Kontroll‑ und Governancefragen hinaus, dieser Beitrag fokussiert aber bewusst auf die Anknüpfungspunkte zum internen Kontrollsystem (IKS) von Banken.Bei näherem Hinsehen zeigt sich jedoch: Für Banken führt der AI-Act keinen völlig neuen Governance‑Kosmos ein, sondern konkretisiert bekannte aufsichtsrechtliche Prinzipien und ordnet sie ausdrücklich auf AI‑Systeme, insbesondere Hochrisiko‑AI‑Systeme, an. Seine Anforderungen lassen sich strukturell in das bestehende interne Kontrollsystem (IKS) nach MaRisk und EBA‑Guidelines einbetten.

Damit verschiebt sich die Perspektive: Die zentrale Frage ist weniger „Brauchen wir neue Strukturen?“, sondern „Wie verankern wir AI-Anwendungen sauber im bestehenden IKS – von der First Line bis zur Internen Revision?“.

Governance, Anbieterrolle und IKS: Wer trägt die Verantwortung?

Der AI-Act verpflichtet Anbieter von Hochrisiko AI-Systemen zur Einrichtung eines Qualitätsmanagementsystems, das die Einhaltung der Verordnung sicherstellt (Art. 17 Abs. 1). Dieses Qualitätsmanagementsystem ist aus Banksicht nicht als Parallelwelt zum bestehenden IKS zu verstehen, sondern als AI spezifische Ausgestaltung und Ergänzungder bestehenden Governance und Kontrollrahmen.

Zentral ist zunächst die Frage, ab wann eine Bank überhaupt als Anbieter eines Hochrisiko‑AI‑Systems gilt:Eine Bank gilt als Anbieter eines Hochrisiko‑AI‑Systems, wenn sie ein entsprechendes System zur Kreditwürdigkeitsprüfung selbst (oder durch Dritte) entwickelt und unter eigener Verantwortung im Institut einsetzt – unabhängig davon, ob es extern vermarktet oder nur intern genutzt wird. Nimmt die Bank an einem bestehenden Hochrisiko‑AI‑System wesentliche Änderungen vor, die über die ursprüngliche Konformitätsbewertung hinausgehen, kann sie ebenfalls als Anbieter des geänderten Systems gelten und muss die einschlägigen Anforderungen des AI-Act erfüllen; maßgeblich sind hierbei insbesondere die Einstufung als Hochrisiko‑Use‑Case, die Anbieterdefinition, die Regeln zur Rollenverschiebung bei wesentlichen Änderungen, die Vorgaben zur Konformitätsbewertung sowie die hierzu erlassenen Erwägungsgründe (insbesondere Anhang III Nr. 5 Buchst. b, Art. 3 Nr. 3, Art. 8–16, Art. 25, Art. 43, Erwägungsgründe 84 und 128 AI-Act).

Damit ist die Governance Frage unmittelbar mit dem IKS verknüpft: Wo AI-Systeme fachlich verantwortet, freigegeben und verändert werden, muss das IKS diese Verantwortung strukturell und prozessual abbilden.

Qualitätsmanagementsystem vs. IKS: Ergänzung statt Doppelstruktur

Das nach Art. 17 AI-Act geforderte Qualitätsmanagementsystem umfasst u.a. Compliance-Konzept, Entwicklungs und Testprozesse, Datenmanagement, Risikomanagement, Post-Market-Monitoring und Incident Reporting. Für Banken mit einem ausgereiften IKS stellt sich daher nicht die Frage, ob sie „ein zweites System“ aufbauen müssen, sondern wie sie die AI-Act Elemente in ihre bestehenden Strukturen integrieren.

Art. 17 Abs. 4 AI-Act ist hierfür der entscheidende Anknüpfungspunkt: Bei Finanzinstituten,die bereits aufgrund europäischer FinanzmarktregulierungAnforderungen an ihre internen Governance‑ und Kontrollregelungen erfüllen, gilt die Pflichtzur Einrichtungeines Qualitätsmanagementsystems – mit Ausnahme der Anforderungen zu Risikomanagementsystem (Art. 9), Post-Market-Monitoring (Art. 72) und Meldung schwerwiegender Vorfälle (Art. 73) – als erfüllt, wenn das bestehende Governance-System den einschlägigen Finanzmarktvorschriften entspricht.

Damit lässt sich das Qualitätsmanagementsystem wie folgt vom IKS abgrenzen:

- Das IKS bildet denübergeordneten Rahmender internen Governance, Verantwortlichkeiten, Prozesse und Kontrollen (MaRisk AT 3, AT 4.3, AT 4.4; EBA Internal Governance).

- Das AI-Act Qualitätsmanagementsystem konkretisiert innerhalb dieses Rahmens AI-spezifische Regeln und Verfahrenüber den gesamten Lebenszyklus von Hochrisiko AI-Systemen (Entwurf, Entwicklung, Betrieb, Monitoring, Änderungen).

Für Banken heißt das: Das bestehende IKS bleibt der strukturelle Träger; AI-Act Pflichten werden als AI-spezifische Ausprägung (Policies, Prozesse, Kontrollen, Rollen) in das IKS integriert.

Three Lines of Defence: Wie das IKS AI‑Kontrolle organisiert

Die EBA Guidelines Internal Governance verlangen eine klare Trennung von Funktionen und die Einrichtung unabhängiger Kontrollfunktionen; in der Praxis wird dies regelmäßig durch das Three Lines of Defence Modell umgesetzt. Genau hier knüpft der AI-Act an:

- Art. 17 fordert klare Verantwortlichkeiten und einen Rechenschaftsrahmen für Leitung und Mitarbeiter im Umgang mit Hochrisiko AI-Systemen.

- Art. 14 verlangt eine wirksame menschliche Aufsicht mit echten Eingriffsmöglichkeiten, nicht nur ein „Mitlesen“.

- Art. 11–13 verlangen Dokumentation, Transparenz und Nachvollziehbarkeit, die für Prüfung und unabhängige Kontrolle nutzbar sind.

Diese Anforderungen lassen sich funktional in das bestehende IKS und seine Three Lines Logik einbetten:

- First Line (Geschäft / Fachbereich) verantwortet den AI-Use-Case fachlich, die laufende Risiko Steuerung und die Einhaltung der Vorgaben im operativen Betrieb.

- Second Line (Risikocontrolling, Compliance) setzt AI-Policies, führt unabhängige Risiko Analysen (inkl. Grundrechts, Bias und Transparenzrisiken) durch und überwacht die Umsetzung.

- Third Line (Interne Revision) prüft Konzeption, Implementierung und Wirksamkeit der AI-Kontrollen, einschließlich Konformität mit AI-Act, MaRisk und internen Richtlinien.

So entsteht keine Parallelwelt, sondern eineAI-Act Erweiterungder bekannten IKS-Struktur.

Risikomanagement und Dokumentation: Bekannte Methoden, neue Inhalte

Art. 9 AI-Act verpflichtet Anbieter von Hochrisiko AI-Systemen zur Einrichtung eines kontinuierlichen Risikomanagementsystems über den gesamten Lebenszyklus des Systems (Identifikation, Analyse, Bewertung, Steuerung, Überwachung). Methodisch entspricht dies der Risikosystematik aus MaRisk (insb. AT 4.3.2) und den EBA-Guidelines; neu ist dieinhaltliche Perspektive:

- expliziter Fokus auf Grundrechtsrisiken, Diskriminierung und Verzerrungen,

- Anforderungen an Transparenz, Nachvollziehbarkeit und menschliche Aufsicht,

- lebenszyklusweite Betrachtung mit Post-Market-Monitoring und Incident Reporting.

Auch bei Dokumentation und Logging knüpft der AI-Act an bekannte Prüfungsgrundsätze an: MaRisk AT 6 verlangt bereits eine vollständige und nachvollziehbare Dokumentation wesentlicher Prozesse, Systeme und Entscheidungen. Der AI-Act konkretisiert dies für AI‑Systeme, indem er technische Dokumentation, Modell‑ und Datenversionierung, Protokollierung und Nachvollziehbarkeit von Entscheidungen für Hochrisiko‑AI ausdrücklich fordert.

Damit erweitert der AI-Act bestehende IKS-Pflichten nicht strukturell, sonderninhaltlichum AI spezifische Risiko und Dokumentationsanforderungen.

Fazit: IKS Evolution statt regulatorischer Bruch

Für Banken ist der EU AI-Act kein Schockereignis, sondern eine konsequente Präzisierung und Erweiterung bestehender aufsichtsrechtlicher Anforderungen auf den Einsatz von AI. Die grundlegenden Strukturen – Governance, internes Kontrollsystem, Three Lines of Defence, Risikomanagement, Dokumentation – sind in der Regel bereits vorhanden.Der entscheidende Erfolgsfaktor liegt darin, AI‑Systeme konsequent in das bestehende IKS zu integrieren und die AI‑Act‑Pflichten (insbesondere für Hochrisiko‑AI) als AI‑spezifische Ausgestaltung dieser Strukturen zu verstehen. Wer den AI-Act als integralen Bestandteil des IKS denkt, vermeidet Doppelstrukturen, behält die aufsichtsrechtliche Logik bei und schafft zugleich Transparenz und Klarheit für alle Linien – von der Produktentwicklung über das Risikomanagement bis hin zur Internen Revision.

Consultant Risk Management, ADVISORI FTC GmbH

Über den Autor

Angelo Tarda absolvierte sein Studium im Studiengang International Finance an der Frankfurt University of Applied Sciences. In seiner Abschlussarbeit beschäftigte er sich mit der Integration von Umweltkriterien in den Kreditvergabeprozess für Wohnimmobilien.

Während seines Studiums unterstützte er als PMO und UAT-Tester ein Projekt zum Aufbau eines ISO-14001-Umweltmanagementsystems bei ADVISORI FTC GmbH.

Seine Projekterfahrung bei einem globalen Finanzdienstleister umfasst insbesondere Tätigkeiten im Kreditrisikomanagement. Er konzipierte und führte fachliche Tests für neue Risikomodelle sowie für Änderungen aufgrund externer Anforderungen durch und begleitete den Implementierungsprozess bis zum erfolgreichen Go-live. Darüber hinaus erstellte er eine Fachspezifikation für den Haircut Service, basierend auf den wesentlichen regulatorischen Anforderungen der CRR III sowie aktualisierten internen Vorgaben. Zusätzlich überarbeitete er eine Kontrolle grundlegend im Internal Control System zur Überwachung der RWA-Berechnung im Kreditrisiko.

Weitere relevante Beiträge

Vertiefen Sie Ihr Wissen mit ausgewählten Artikeln aus der gleichen Themenwelt.

DORA Beratung: So wählen Sie den richtigen Anbieter

Die Wahl des richtigen DORA-Beraters entscheidet über Zeitplan und Prüfungssicherheit der Implementierung. Dieser Leitfaden erklärt 6 Auswahlkriterien, was eine professionelle DORA Readiness-Analyse umfasst und wann externe Beratung sinnvoller ist als eine Inhouse-Lösung.

MaRisk, CRD VI und EBA Guidelines: Was der MaRisk-Entwurf für das Risikomanagement konkret bedeutet

Wie die MaRisk-Novelle Ihr Risikomanagement, ESG-Steuerung und Prüfungssicherheit verändert – und welche Maßnahmen jetzt Eigenkapital, Effizienz und Wettbewerbsfähigkeit schützen.

BRUBEG: Umfangreiche Anpassung des deutschen Bankaufsichtsrechts

BRUBEG 2026 verändert das Bankaufsichtsrecht – erfahren Sie, welche neuen ESG-Pflichten, Governance-Vorgaben und Drittstaatenregeln jetzt Handlungsbedarf für Institute auslösen.

Bereit, Ihr Wissen in Aktion umzusetzen?

Dieser Beitrag hat Ihnen Denkanstöße gegeben. Lassen Sie uns gemeinsam den nächsten Schritt gehen und entdecken, wie unsere Expertise im Bereich Internes Kontrollsystem (IKS) Ihr Projekt zum Erfolg führen kann.

Unverbindlich informieren & Potenziale entdecken.