DQ Requirements Engineering für messbare Datenqualität

DQ Requirements Engineering

Ohne klare Anforderungen scheitern Datenqualitätsinitiativen. Wir unterstützen Sie dabei, Ihre spezifischen Datenqualitätsanforderungen aus Geschäftsprozessen abzuleiten, als messbare DQ-Regeln zu formulieren und nachhaltig im Unternehmen zu verankern.

- ✓Präzise Definition messbarer Datenqualitätsziele und -anforderungen

- ✓Systematische Ableitung von DQ-Regeln aus Geschäftsprozessen und -anforderungen

- ✓Verbesserte Grundlage für die Auswahl und Konfiguration von DQ-Tools

- ✓Erhöhte Transparenz und Nachvollziehbarkeit der Datenqualitätsmaßnahmen

Ihr Erfolg beginnt hier

Bereit für den nächsten Schritt?

Schnell, einfach und absolut unverbindlich.

Zur optimalen Vorbereitung:

- Ihr Anliegen

- Wunsch-Ergebnis

- Bisherige Schritte

Oder kontaktieren Sie uns direkt:

Zertifikate, Partner und mehr...

Was macht professionelles DQ Requirements Engineering aus?

Unsere Stärken

- Methodische Kompetenz im Requirements Engineering speziell für Datenqualität

- Tiefes Verständnis für die Wechselwirkungen zwischen Geschäftsprozessen und Datenqualität

- Erfahrung in der Moderation von Workshops zur Anforderungsermittlung mit Fachbereichen

- Praxisnahe Ableitung von messbaren DQ-Metriken und umsetzbaren DQ-Regeln

⚠

Expertentipp

Ein häufiger Fehler ist die Definition zu generischer DQ-Anforderungen. Effektives DQ Requirements Engineering fokussiert auf den spezifischen Kontext: Welche Datenqualität ist für *diesen* Prozess oder *diese* Entscheidung *wirklich* notwendig? Durch die Priorisierung und kontextbezogene Definition vermeiden Sie unnötigen Aufwand und stellen sicher, dass Ihre DQ-Investitionen den größten Nutzen bringen.

ADVISORI in Zahlen

11+

Jahre Erfahrung

120+

Mitarbeiter

520+

Projekte

Ein strukturiertes Vorgehen ist entscheidend, um sicherzustellen, dass alle relevanten Datenqualitätsanforderungen erfasst, verstanden und korrekt dokumentiert werden. Unser Ansatz kombiniert bewährte Methoden des Requirements Engineering mit spezifischem DQ-Know-how.

Unser Vorgehen

1

Phase 1

Phase 1: Scoping & Kontextanalyse - Definition des Untersuchungsbereichs, Identifikation relevanter Stakeholder und Analyse der betroffenen Geschäftsprozesse und Datenobjekte

2

Phase 2

Phase 2: Anforderungsermittlung - Systematische Erhebung der DQ-Anforderungen durch Interviews, Workshops und Analyse bestehender Dokumentationen

3

Phase 3

Phase 3: Spezifikation & Modellierung - Präzise Formulierung und Dokumentation der Anforderungen, Definition von DQ-Metriken und -Regeln

4

Phase 4

Phase 4: Validierung & Priorisierung - Überprüfung der Anforderungen auf Vollständigkeit, Konsistenz und Machbarkeit mit den Stakeholdern; Festlegung von Prioritäten

5

Phase 5

Phase 5: Management & Übergabe - Verwaltung der Anforderungen über den Lebenszyklus und Übergabe an die Implementierungsphase (DQ-Monitoring, -Regeln)

"Datenqualität beginnt mit klaren Anforderungen. Ohne ein solides Requirements Engineering laufen DQ-Initiativen Gefahr, an den eigentlichen Bedürfnissen des Business vorbeizugehen. Nur wer genau weiß, welche Qualität für welchen Zweck benötigt wird, kann Ressourcen effizient einsetzen und nachhaltige Verbesserungen erzielen."

Asan Stefanski

Head of Digital Transformation

Expertise & Erfahrung:

11+ Jahre Erfahrung, Studium Angewandte Informatik, Strategische Planung und Leitung von KI-Projekten, Cyber Security, Secure Software Development, AI

Unsere Dienstleistungen

Wir bieten Ihnen maßgeschneiderte Lösungen für Ihre digitale Transformation

DQ-Anforderungsanalyse für Geschäftsprozesse

Wir analysieren Ihre kritischen Geschäftsprozesse, identifizieren die relevanten Datenobjekte und leiten daraus spezifische Anforderungen an die Datenqualität ab. So stellen wir sicher, dass Ihr DQM direkt auf die Verbesserung Ihrer operativen Abläufe einzahlt.

- Prozessorientierte Identifikation von DQ-kritischen Datenpunkten

- Ermittlung der Auswirkungen von DQ-Problemen auf Prozess-KPIs

- Definition von DQ-Anforderungen zur Sicherstellung der Prozessintegrität

- Ableitung von Anforderungen für präventive Kontrollen in Prozessen

Definition von DQ-Metriken und KPIs

Übersetzung Ihrer DQ-Anforderungen in messbare Metriken und Key Performance Indicators (KPIs). Wir helfen Ihnen, die richtigen Messgrößen zu definieren, um den Erfolg Ihrer DQ-Maßnahmen transparent zu machen und kontinuierlich zu steuern.

- Auswahl geeigneter Metriken für jede relevante DQ-Dimension

- Entwicklung spezifischer Berechnungslogiken für DQ-Metriken

- Definition von Zielwerten und Schwellenwerten für DQ-KPIs

- Konzeption von DQ-Dashboards und -Reports zur Visualisierung

Spezifikation von DQ-Regeln

Formulierung präziser, technisch umsetzbarer Datenqualitätsregeln basierend auf den ermittelten Anforderungen. Wir dokumentieren die Regeln detailliert als Grundlage für die Implementierung in DQ-Tools oder Datenverarbeitungsprozessen.

- Übersetzung von Geschäftsanforderungen in formale Regel-Logik

- Definition von Prüflogiken für verschiedene DQ-Dimensionen (Validität, Konsistenz etc.)

- Spezifikation von Datenquellen, Attributen und Bedingungen für jede Regel

- Dokumentation der Regeln inklusive Schweregrad und Verantwortlichkeit

DQ Requirements für Datenmigrationen

Spezifische Ermittlung und Definition von Datenqualitätsanforderungen im Kontext von Datenmigrationsprojekten. Wir stellen sicher, dass die Qualität der Daten beim Übergang in neue Systeme erhalten bleibt oder gezielt verbessert wird.

- Analyse der Datenqualität in Quell- und Zielsystemen

- Definition von DQ-Anforderungen für den Migrationsprozess (Transformation, Validierung)

- Spezifikation von DQ-Prüfungen vor, während und nach der Migration

- Planung von Datenbereinigungsaktivitäten im Rahmen der Migration

Unsere Kompetenzen im Bereich Datenqualitätsmanagement

Wählen Sie den passenden Bereich für Ihre Anforderungen

Datenqualitäts-Audit

Verschaffen Sie sich einen objektiven und umfassenden Überblick über den Qualitätszustand Ihrer kritischen Datenbestände. Unsere strukturierten Datenqualitäts-Audits liefern tiefe Einblicke, decken Schwachstellen auf und identifizieren konkrete Optimierungspotenziale als Grundlage für gezielte Verbesserungsmaßnahmen.

Datenqualitätsmanagement Implementierung

Transformieren Sie Ihre Datenqualitätsstrategie in messbare Ergebnisse. Unsere erprobte Implementierungsmethodik unterstützt Sie bei der nachhaltigen Verankerung des Datenqualitätsmanagements in Ihrer Organisation – mit klarem Fokus auf Geschäftswert, Effizienz und kontinuierliche Verbesserung.

Häufig gestellte Fragen zur DQ Requirements Engineering

Was ist DQ Requirements Engineering und warum ist es wichtig?

DQ Requirements Engineering ist der systematische Prozess zur Ermittlung, Spezifikation, Dokumentation und Validierung von Anforderungen an die Datenqualität. Es bildet die Brücke zwischen den Geschäftsanforderungen und den konkreten Maßnahmen des Datenqualitätsmanagements (DQM).**Warum ist es wichtig?

*** **Zielgerichtetes DQM:

*

* Ohne klare Anforderungen sind DQ-Maßnahmen oft ineffektiv oder zielen am Bedarf vorbei. Requirements Engineering stellt sicher, dass sich DQM auf die wirklich kritischen Aspekte konzentriert.

* **Messbarkeit:

*

* Es definiert, *was

* gemessen werden soll (Metriken) und *welche

* Güte erwartet wird (Schwellenwerte), um den Erfolg von DQ-Initiativen bewerten zu können.

* **Grundlage für DQ-Regeln:

*

* Präzise Anforderungen sind die Basis für die Formulierung eindeutiger und technisch umsetzbarer DQ-Regeln.

* **Kommunikation & Verständnis:

*

* Es schafft ein gemeinsames Verständnis zwischen Fachbereichen und IT über die Erwartungen an die Datenqualität.

* **Effizienz:

*

* Durch die Fokussierung auf relevante Anforderungen werden unnötige DQ-Prüfungen und -Bereinigungen vermieden.

Wie unterscheidet sich DQ Requirements Engineering von allgemeinem Requirements Engineering?

Während allgemeines Requirements Engineering sich auf die Anforderungen an Software, Systeme oder Prozesse konzentriert, fokussiert DQ Requirements Engineering spezifisch auf die **Qualitätsanforderungen an die Daten selbst**, die von diesen Systemen und Prozessen genutzt oder erzeugt werden.**Spezifische Aspekte des DQ Requirements Engineering:

*** **Fokus auf Datenobjekte:

*

* Betrachtet werden spezifische Datenobjekte (z.B. Kunde, Produkt, Vertrag) und deren Attribute.

* **DQ-Dimensionen:

*

* Anforderungen werden entlang spezifischer Datenqualitätsdimensionen (Genauigkeit, Vollständigkeit, Konsistenz, Aktualität etc.) strukturiert.

* **Messbarkeit im Vordergrund:

*

* Ein starker Fokus liegt auf der Definition messbarer Metriken und Schwellenwerte für die Datenqualität.

* **Kontextabhängigkeit:

*

* DQ-Anforderungen sind oft stark kontextabhängig (z.B. kann die erforderliche Aktualität von Kundendaten je nach Prozess variieren).

* **Bezug zu Geschäftsprozessen:

*

* Anforderungen werden oft direkt aus den Bedürfnissen spezifischer Geschäftsprozesse abgeleitet (Welche Datenqualität braucht dieser Prozess, um korrekt zu funktionieren?).

* **Lebenszyklus:

*

* Berücksichtigt den gesamten Datenlebenszyklus von der Erfassung bis zur Archivierung.Es nutzt zwar ähnliche Techniken (Interviews, Workshops, Analyse), wendet diese aber mit einem spezifischen Blick auf die Eigenschaften und Qualitätsmerkmale von Daten an.

Welche Methoden werden zur Ermittlung von DQ-Anforderungen eingesetzt?

Die Ermittlung von Datenqualitätsanforderungen ist ein kommunikativer Prozess, der verschiedene Methoden kombiniert, um die Bedürfnisse der Stakeholder zu verstehen:

* **Interviews:

*

* Gezielte Gespräche mit Fachexperten, Data Stewards, Prozessverantwortlichen und Datennutzern, um deren Erwartungen, Probleme und Bedarfe bezüglich der Datenqualität zu verstehen.

* **Workshops:

*

* Moderierte Gruppensitzungen mit verschiedenen Stakeholdern zur gemeinsamen Identifikation, Diskussion und Priorisierung von DQ-Anforderungen.

* **Dokumentenanalyse:

*

* Prüfung bestehender Prozessbeschreibungen, Fachkonzepte, Reports, gesetzlicher Vorgaben oder Richtlinien auf implizite oder explizite DQ-Anforderungen.

* **Datenprofilierung (Data Profiling):

*

* Technische Analyse von Datenbeständen, um Muster, Anomalien und potenzielle Qualitätsprobleme aufzudecken. Dies liefert oft Hinweise auf notwendige Anforderungen (z.B. wenn viele Nullwerte auftreten -> Anforderung an Vollständigkeit).

* **Beobachtung:

*

* Begleitung von Mitarbeitern bei ihrer Arbeit mit den Daten, um zu verstehen, wie Daten genutzt werden und wo Qualitätsprobleme auftreten.

* **Fragebögen:

*

* Standardisierte Abfrage von Anforderungen bei einer größeren Anzahl von Stakeholdern.

* **Analyse von Fehlerprotokollen/Tickets:

*

* Untersuchung gemeldeter Probleme und Fehler, um wiederkehrende DQ-Probleme und deren Ursachen zu identifizieren.Die Kombination dieser Methoden ermöglicht ein umfassendes Bild der benötigten Datenqualität aus verschiedenen Perspektiven.

Wie priorisiert man Datenqualitätsanforderungen?

Da es oft nicht möglich oder wirtschaftlich sinnvoll ist, *alle

* potenziellen DQ-Anforderungen sofort umzusetzen, ist eine Priorisierung entscheidend. Gängige Kriterien zur Priorisierung sind: 1. **Geschäftskritikalität (Business Impact):

**

* Welche Auswirkungen hat eine Nichterfüllung der Anforderung auf wichtige Geschäftsprozesse, Entscheidungen, Kosten oder die Einhaltung von Vorschriften?

* Anforderungen, deren Verletzung hohe Risiken oder Kosten verursacht, erhalten eine höhere Priorität. 2. **Häufigkeit des Problems:

**

* Wie oft tritt das Datenqualitätsproblem auf, das durch die Anforderung adressiert wird?

* Häufig auftretende Probleme werden oft höher priorisiert. 3. **Abhängigkeiten:

**

* Gibt es Abhängigkeiten zwischen verschiedenen Anforderungen? Muss eine Anforderung erfüllt sein, bevor eine andere sinnvoll umgesetzt werden kann? 4. **Umsetzungsaufwand:

**

* Wie komplex und aufwändig ist die technische und organisatorische Umsetzung der Anforderung (z.B. Implementierung einer DQ-Regel, Anpassung eines Prozesses)?

* Manchmal werden \"Quick Wins\" (hoher Nutzen bei geringem Aufwand) vorgezogen. 5. **Strategische Bedeutung:

**

* Unterstützt die Erfüllung der Anforderung strategische Ziele des Unternehmens (z.B. Verbesserung der Customer Experience, Einführung neuer digitaler Services)? 6.

Wie dokumentiert man DQ-Anforderungen richtig?

Eine klare, präzise und einheitliche Dokumentation von Datenqualitätsanforderungen ist entscheidend für deren erfolgreiche Umsetzung. Folgende Aspekte sollten berücksichtigt werden: **Formale Struktur:

** * **Eindeutige ID/Kennung:

*

* Zur einfachen Referenzierung und Nachverfolgung.

* **Klassifikation:

*

* Kategorisierung nach DQ-Dimension (z.B. Vollständigkeit, Genauigkeit) und betroffenen Datenobjekten/Attributen.

* **Beschreibung:

*

* Klare und präzise Formulierung, was genau gefordert wird.

* **Metriken:

*

* Wie wird die Erfüllung der Anforderung gemessen?

* **Schwellenwerte:

*

* Wann gilt die Anforderung als erfüllt/nicht erfüllt?

* **Priorität/Kritikalität:

*

* Wie wichtig ist diese Anforderung im Vergleich zu anderen?

* **Verantwortlichkeiten:

*

* Wer ist für die Umsetzung und Überwachung zuständig?

* **Quelle:

*

* Woher stammt die Anforderung (z.B. Geschäftsprozess, regulatorische Vorgabe)? **Dokumentationsebenen:

** * **Geschäftsanforderungen:

*

* Formuliert in der Sprache der Fachbereiche, ohne technische Details.

* **Funktionale Spezifikationen:

** Überführung in messbare, technisch umsetzbare Anforderungen.

* **Technische Spezifikationen:

*

* Konkrete technische Umsetzung (z.B. SQL-Abfragen, Regeldefinitionen für DQ-Tools). **Best Practices:

** * **Templatebasiert:

*

* Verwendung standardisierter Vorlagen für einheitliche Dokumentation.

* **Nachvollziehbarkeit:

*

* Klare Verbindung zwischen Geschäftsanforderungen und technischer Umsetzung.

* **Angemessener Detaillierungsgrad:

*

* Detailliert genug für eindeutige Umsetzung, aber nicht übermäßig komplex.

Wie hängen DQ-Anforderungen mit Data Governance zusammen?

DQ Requirements Engineering und Data Governance sind eng miteinander verknüpft und verstärken sich gegenseitig. Ihre Beziehung lässt sich wie folgt beschreiben: **Data Governance als Rahmen:

**

* Data Governance bildet den organisatorischen und prozessualen Rahmen für das Datenqualitätsmanagement.

* Sie definiert Rollen, Verantwortlichkeiten und Entscheidungsstrukturen für datenqualitätsbezogene Themen.

* Sie gibt vor, wer Datenqualitätsanforderungen definieren, genehmigen und überprüfen darf. **DQ Requirements als operativer Input:

**

* Präzise definierte DQ-Anforderungen sind wiederum die Basis für eine effektive Data Governance.

* Sie geben vor, was konkret überwacht und gesteuert werden muss.

* Sie ermöglichen die Operationalisierung der in der Governance definierten Qualitätsziele. **Konkrete Berührungspunkte:

** * **Datenqualitätspolicy:

*

* Die übergreifende DQ-Policy (Teil der Data Governance) gibt Rahmenbedingungen für die Definition spezifischer DQ-Anforderungen vor.

* **Data Ownership:

*

* Data Governance definiert Data Owner, die maßgeblich an der Definition von DQ-Anforderungen für "ihre" Daten beteiligt sind.

* **Data Stewardship:

*

* Data Stewards (definiert im Governance-Modell) setzen DQ-Anforderungen um und überwachen deren Einhaltung.

* **Genehmigungsprozesse:

*

* Die Governance definiert, wer DQ-Anforderungen freigeben muss.

Wie leitet man DQ-Anforderungen aus Geschäftsprozessen ab?

Die Ableitung von Datenqualitätsanforderungen aus Geschäftsprozessen ist ein methodischer Ansatz, um sicherzustellen, dass die DQ-Maßnahmen tatsächlich dort ansetzen, wo sie den größten Geschäftswert schaffen. Der Prozess umfasst folgende Schritte: 1. **Prozesspriorisierung:

**

* Identifikation kritischer Geschäftsprozesse mit hoher Abhängigkeit von Datenqualität.

* Berücksichtigung von Faktoren wie Geschäftskritikalität, bekannte DQ-Probleme und Automatisierungsgrad. 2. **Prozessanalyse:

**

* Detaillierte Analyse des ausgewählten Prozesses (z.B. mittels BPMN).

* Identifikation aller Prozessschritte, die Daten nutzen oder erzeugen.

* Erfassung der Datenflüsse innerhalb des Prozesses. 3. **Identifikation kritischer Datenpunkte:

**

* Welche Daten/Attribute sind für den Prozess besonders wichtig?

* An welchen Stellen im Prozess haben Datenqualitätsprobleme besonders gravierende Auswirkungen? 4. **Auswirkungsanalyse:

**

* Untersuchung, wie sich mangelnde Datenqualität auf den Prozess auswirken würde.

* Erstellung von "Failure Scenarios" (Was passiert, wenn bestimmte Daten falsch, unvollständig oder veraltet sind?).

* Bewertung der potenziellen Auswirkungen (z.B. finanziell, operativ, regulatorisch, Kundenbeziehung). 5. **Definition von DQ-Anforderungen:

**

* Ableitung konkreter DQ-Anforderungen aus den identifizierten Risiken.

* Berücksichtigung der relevanten DQ-Dimensionen für jeden kritischen Datenpunkt.

Welche Tools und Technologien unterstützen das DQ Requirements Engineering?

Verschiedene Kategorien von Tools und Technologien können den Prozess des DQ Requirements Engineering unterstützen: 1. **Anforderungsmanagement-Tools:

** * **Allgemeine RM-Tools:

*

* JIRA, IBM Rational DOORS, Polarion Requirements

* **Funktionen:

*

* Erfassung, Versionierung, Nachverfolgung von Anforderungen, Traceability-Matrizen

* **Vorteile:

*

* Strukturierte Erfassung, Änderungshistorie, Verknüpfung mit anderen Projektartefakten 2. **Datenqualitätsmanagement-Plattformen:

** * **Beispiele:

*

* Informatica Data Quality, Talend Data Quality, IBM InfoSphere Information Server

* **Funktionen:

*

* Integrierte Umgebungen für Definition, Implementierung und Monitoring von DQ-Regeln

* **Vorteile:

*

* End-to-End-Lösung, spezialisiert auf DQ-Anforderungen 3. **Datenprofiling-Tools:

** * **Beispiele:

*

* SAS Data Management, Profiler in ETL-Tools, Open-Source-Lösungen wie Apache Griffin

* **Funktionen:

*

* Automatische Analyse von Datenbeständen zur Identifikation potenzieller Qualitätsprobleme

* **Vorteile:

*

* Unterstützt die evidenzbasierte Definition von DQ-Anforderungen 4. **Data Catalog & Metadata Management:

** * **Beispiele:

*

* Collibra, Alation, Informatica Enterprise Data Catalog

* **Funktionen:

*

* Zentrale Verwaltung von Metadaten, inkl. DQ-Anforderungen und -Regeln

* **Vorteile:

*

* Kontext für DQ-Anforderungen, Verbindung zu Business Glossaries und Datenlineage 5.

Welche Rolle spielen Business Glossaries bei der Definition von DQ-Anforderungen?

Business Glossaries sind wesentliche Grundlagen für ein effektives DQ Requirements Engineering und spielen gleich mehrere wichtige Rollen: 1. **Schaffung einer einheitlichen Sprache:

**

* Business Glossaries definieren Begriffe und Konzepte einheitlich für das gesamte Unternehmen.

* Sie verhindern Missverständnisse bei der Definition von DQ-Anforderungen durch unterschiedliche Interpretationen von Fachbegriffen.

* Beispiel: Wenn ein "Kunde" im Vertrieb anders definiert ist als im Kundenservice, führt dies zu widersprüchlichen DQ-Anforderungen. 2. **Kontextbereitstellung für Datenobjekte:

**

* Sie liefern den geschäftlichen Kontext für Datenobjekte und -attribute.

* Dieser Kontext ist entscheidend, um relevante DQ-Dimensionen und -anforderungen zu identifizieren.

* Beispiel: Die Definition eines "aktiven Kunden" bestimmt, welche Aktualitätsanforderungen an Kundendaten gestellt werden müssen. 3. **Verbindung zum Datenmodell:

**

* Moderne Business Glossaries sind oft mit dem technischen Datenmodell verknüpft.

* Diese Verknüpfung ermöglicht die Nachverfolgung von Geschäftsbegriffen zu den konkreten Datenfeldern in verschiedenen Systemen.

* So wird sichergestellt, dass DQ-Anforderungen auf die richtigen technischen Entitäten angewendet werden. 4. **Grundlage für DQ-Regeln:

**

* Definitionen im Glossar können direkt in DQ-Regeln übersetzt werden.

Wie berücksichtigt man Datenschutz und regulatorische Anforderungen im DQ Requirements Engineering?

Datenschutz und regulatorische Anforderungen sind integraler Bestandteil eines umfassenden DQ Requirements Engineering. Ihre Berücksichtigung umfasst folgende Aspekte: 1. **Identifikation relevanter Regulierungen:

**

* Ermittlung aller für die Organisation und die spezifischen Daten geltenden gesetzlichen Vorgaben (z.B. DSGVO, BDSG, branchenspezifische Regularien wie Basel III, Solvency II, HIPAA).

* Einbeziehung interner Richtlinien und Standards.

* Regelmäßige Überprüfung auf Aktualisierungen der regulatorischen Landschaft. 2. **Übersetzung in DQ-Anforderungen:

**

* Analyse, welche Datenqualitätsaspekte zur Einhaltung der Vorgaben erforderlich sind.

* Beispiele:

* DSGVO-Prinzip der "Richtigkeit": Anforderungen an Genauigkeit und Aktualität personenbezogener Daten.

* Meldepflichten: Vollständigkeit und Konsistenz regulatorischer Berichte.

* Aufbewahrungspflichten: Anforderungen an Historisierung und Nachvollziehbarkeit. 3. **Priorisierung regulatorischer DQ-Anforderungen:

**

* Regulatorische Anforderungen haben oft eine hohe Priorität aufgrund potenzieller rechtlicher Konsequenzen bei Nichteinhaltung.

* Risikobewertung basierend auf Schwere möglicher Verstöße und Wahrscheinlichkeit. 4. **Integration in das DQ-Framework:

**

* Einbettung regulatorischer Anforderungen in das bestehende DQ-Regelwerk.

* Verknüpfung mit betroffenen Geschäftsprozessen und Datenbereichen.

* Sicherstellung der Nachweisbarkeit (Compliance-Dokumentation). 5. **Spezifische Datenschutzaspekte:

**

* Speicherbegrenzung: DQ-Anforderungen für Datenbereinigung und -löschung.

Wie validiert man die Wirksamkeit definierter DQ-Anforderungen?

Die Validierung der Wirksamkeit von DQ-Anforderungen ist entscheidend, um sicherzustellen, dass die definierten Anforderungen tatsächlich zur Verbesserung der Datenqualität und zur Unterstützung der Geschäftsprozesse beitragen. Dieser Prozess umfasst mehrere Aspekte: 1. **Überprüfung der Angemessenheit:

** * **Fachliche Validierung:

*

* Bestätigung durch Fachexperten, dass die Anforderungen die tatsächlichen Geschäftsbedürfnisse abdecken.

* **Vollständigkeitsprüfung:

*

* Sicherstellung, dass alle relevanten DQ-Dimensionen für kritische Daten berücksichtigt wurden.

* **Konsistenzprüfung:

** Überprüfung auf Widersprüche zwischen verschiedenen Anforderungen. 2. **Technische Machbarkeit:

**

* Bewertung, ob die Anforderungen mit vorhandenen Systemen und Tools messbar und überprüfbar sind.

* Identifikation von technischen Einschränkungen, die die Umsetzung behindern könnten.

* Prüfung der Implementierbarkeit von DQ-Regeln. 3. **Pilotierung:

**

* Testweise Anwendung der Anforderungen auf eine Teilmenge der Daten.

* Bewertung der initialen Ergebnisse und Anpassung bei Bedarf.

* Identifikation unerwarteter Herausforderungen oder Nebenwirkungen. 4. **Wirksamkeitsmessung nach Implementierung:

** * **Quantitative Metriken:

*

* Messen der Datenqualitätsverbesserung anhand definierter KPIs.

* **Qualitative Bewertung:

*

* Feedback von Datennutzern zur wahrgenommenen Qualitätsverbesserung.

* **Auswirkungsanalyse:

*

* Bewertung der Auswirkungen auf die unterstützten Geschäftsprozesse. 5.

Wie unterscheiden sich DQ-Anforderungen für verschiedene Datentypen (Stamm-, Bewegungs-, Referenzdaten)?

Die DQ-Anforderungen variieren erheblich je nach Datentyp, da unterschiedliche Daten verschiedene Charakteristika, Nutzungsmuster und Bedeutungen für das Unternehmen haben: **Stammdaten (Master Data):

** * **Charakteristik:

*

* Grundlegende, langlebige Geschäftsentitäten (z.B. Kunden, Produkte, Mitarbeiter, Lieferanten).

* **Typische DQ-Dimensionen im Fokus:

** * **Eindeutigkeit:

*

* Keine Duplikate in Kundendaten, eindeutige Produktcodes.

* **Genauigkeit:

*

* Korrekte Attributwerte wie Adressen, Produktspezifikationen.

* **Vollständigkeit:

*

* Alle erforderlichen Attribute sind vorhanden.

* **Standardisierung:

*

* Einheitliche Formate und Klassifikationen.

* **Spezifische Anforderungen:

**

* Strikte Governance für Änderungen.

* Klare Verantwortlichkeiten (Data Ownership).

* Regelungen für Golden Records bei mehreren Quellsystemen. **Bewegungsdaten (Transaktional Data):

** * **Charakteristik:

*

* Geschäftsvorgänge und -transaktionen (z.B. Bestellungen, Zahlungen, Logistikprozesse).

* **Typische DQ-Dimensionen im Fokus:

** * **Zeitnähe:

*

* Schnelle Verarbeitung und Verfügbarkeit.

* **Integrität:

*

* Korrekte Verknüpfung mit Stammdaten.

* **Vollständigkeit:

*

* Alle transaktionsrelevanten Informationen erfasst.

* **Nachvollziehbarkeit:

*

* Audit Trails für kritische Transaktionen.

* **Spezifische Anforderungen:

**

* Performante Validierung während der Erfassung.

* Prüfung auf Geschäftsregelverletzungen.

* Zeitnahe Fehlererkennung und -korrektur. **Referenzdaten (Reference Data):

** * **Charakteristik:

*

* Klassifikationen, Codes, Hierarchien (z.B. Währungscodes, Ländercodes, Produktkategorien).

Wie entwickelt man eine ganzheitliche DQ-Anforderungsstrategie?

Eine ganzheitliche DQ-Anforderungsstrategie geht über die Definition einzelner Anforderungen hinaus und bettet diese in einen systematischen, organisationsweiten Rahmen ein. Folgende Elemente sind dafür entscheidend: 1. **Strategische Ausrichtung:

** * **Alignment mit Unternehmenszielen:

*

* Verknüpfung der DQ-Anforderungsstrategie mit den übergeordneten Geschäftszielen.

* **Berücksichtigung der Datenstrategie:

*

* Integration in die gesamte Datenstrategie des Unternehmens.

* **Geschäftsfokus:

*

* Priorisierung von Anforderungen, die den größten geschäftlichen Mehrwert bieten. 2. **Organisatorische Aspekte:

** * **Verantwortlichkeiten:

*

* Klare Definition, wer für die Erstellung, Genehmigung und Überwachung von DQ-Anforderungen zuständig ist.

* **Einbindung von Stakeholdern:

*

* Systematische Beteiligung aller relevanten Fachbereiche und der IT.

* **Schulung und Awareness:

*

* Maßnahmen zur Sensibilisierung für die Bedeutung von Datenqualität und die definierten Anforderungen. 3. **Methodische Elemente:

** * **Standardisierte Prozesse:

*

* Etablierung einheitlicher Prozesse für die Ermittlung, Dokumentation und Validierung von DQ-Anforderungen.

* **Klassifizierungssystem:

*

* Framework zur Kategorisierung von Anforderungen (z.B. nach Datendomäne, DQ-Dimension, Kritikalität).

* **Lebenszyklusmanagement:

*

* Prozesse zur regelmäßigen Überprüfung und Aktualisierung von Anforderungen. 4. **Technologische Unterstützung:

** * **Tool-Strategie:

*

* Auswahl geeigneter Tools für die Verwaltung, Implementierung und Überwachung von DQ-Anforderungen.

Wie formuliert man messbare DQ-Anforderungen und -Metriken?

Messbare DQ-Anforderungen und -Metriken sind essentiell, um den Erfolg von Datenqualitätsmaßnahmen objektiv bewerten zu können. Hier sind die wichtigsten Prinzipien und Schritte zur Formulierung: **Prinzipien für messbare DQ-Anforderungen:

** * **Spezifisch:

*

* Eindeutig und präzise formuliert, ohne Interpretationsspielraum.

* **Messbar:

*

* Quantifizierbar durch eine definierte Metrik.

* **Erreichbar:

*

* Realistisch im gegebenen Kontext umsetzbar.

* **Relevant:

*

* Tatsächlicher Mehrwert für Geschäftsprozesse oder Compliance.

* **Zeitgebunden:

*

* Mit klarem Zeitrahmen für die Erfüllung. **Schritte zur Formulierung:

** 1. **Identifikation der relevanten DQ-Dimension:

**

* Bestimmen Sie, welche Dimension (z.B. Vollständigkeit, Genauigkeit, Konsistenz) adressiert werden soll.

* Beispiel: Vollständigkeit von Kundenkontaktdaten. 2. **Definition der konkreten DQ-Anforderung:

**

* Formulieren Sie präzise, was gefordert wird.

* Beispiel: "Alle aktiven Kundenkonten müssen eine E-Mail-Adresse und eine Telefonnummer enthalten." 3. **Entwicklung der passenden Metrik:

**

* Bestimmen Sie, wie die Erfüllung gemessen wird.

* Mathematische Definition: z.B. "Prozentsatz der aktiven Kundenkonten mit ausgefüllter E-Mail-Adresse UND Telefonnummer"

* Formel: (Anzahl aktiver Kundenkonten mit E-Mail UND Telefon) / (Gesamtzahl aktiver Kundenkonten)

* 100% 4.

Wie integriert man DQ Requirements Engineering in agile Entwicklungsprozesse?

Die Integration von DQ Requirements Engineering in agile Entwicklungsprozesse stellt eine besondere Herausforderung dar, da sie traditionell umfassende und vorausschauende Planung erfordert, während agile Methoden inkrementell und adaptiv arbeiten. Hier sind Ansätze zur erfolgreichen Integration: **Grundprinzipien:

** 1. **Frühzeitige Integration:

**

* DQ-Anforderungen von Beginn an als Teil des Product Backlogs berücksichtigen.

* Data Quality by Design: DQ als integraler Bestandteil der Lösungsentwicklung, nicht als Nachgedanke. 2. **Inkrementeller Ansatz:

**

* DQ-Anforderungen in kleine, umsetzbare User Stories herunterbrechen.

* Schrittweise Verfeinerung von allgemeinen zu spezifischen Anforderungen. 3. **Kontinuierliche Validierung:

**

* Regelmäßige Überprüfung der Einhaltung von DQ-Anforderungen in jedem Sprint.

* Frühzeitiges Feedback zur Wirksamkeit der implementierten DQ-Maßnahmen. **Praktische Umsetzung:

** 1. **User Stories für DQ-Anforderungen:

**

* DQ-Anforderungen als eigenständige User Stories formulieren.

* Beispiel: "Als Marketing-Manager möchte ich sicherstellen, dass alle Kundendatensätze eine gültige E-Mail-Adresse haben, damit ich zielgerichtete E-Mail-Kampagnen durchführen kann."

* Definition of Done (DoD) um DQ-Kriterien erweitern. 2. **DQ-Akzeptanzkriterien:

**

* Messbare Akzeptanzkriterien für DQ-Aspekte definieren.

* Beispiel: "95% aller aktiven Kundendatensätze haben eine syntaktisch korrekte E-Mail-Adresse.

Was sind typische Herausforderungen beim DQ Requirements Engineering und wie begegnet man ihnen?

Das DQ Requirements Engineering ist mit verschiedenen Herausforderungen verbunden, die eine erfolgreiche Umsetzung erschweren können. Hier sind die häufigsten Probleme und bewährte Lösungsansätze: 1. **Fehlende Business-Priorisierung:

** * **Problem:

*

* Datenqualität wird oft als rein technisches Thema betrachtet und erhält nicht die notwendige Aufmerksamkeit des Managements.

* **Lösung:

**

* Business Case für DQ-Initiativen entwickeln mit konkreten Kosteneinsparungen und Nutzenpotenzialen.

* DQ-Probleme mit konkreten Geschäftsauswirkungen illustrieren (z.B. verlorene Umsätze, Kundenabwanderung).

* Executive Sponsorship für DQ-Initiativen sichern. 2. **Silodenken und Organisationsbarrieren:

** * **Problem:

*

* DQ-Anforderungen werden isoliert je Abteilung definiert, ohne Berücksichtigung end-to-end Prozesse.

* **Lösung:

**

* Abteilungsübergreifende DQ-Workshops durchführen.

* Process Owner einbinden, die für end-to-end Prozesse verantwortlich sind.

* Gemeinsame Incentives für übergreifende DQ-Verbesserungen schaffen. 3. **Zu abstrakte oder zu detaillierte Anforderungen:

** * **Problem:

*

* DQ-Anforderungen sind entweder zu vage ("Die Daten müssen korrekt sein") oder übermäßig detailliert.

* **Lösung:

**

* Mehrstufigen Ansatz mit Business-Anforderungen und technischen Spezifikationen verfolgen.

* Standardisierte Templates für die Dokumentation verwenden.

* Review-Prozess mit unterschiedlichen Stakeholdern etablieren. 4.

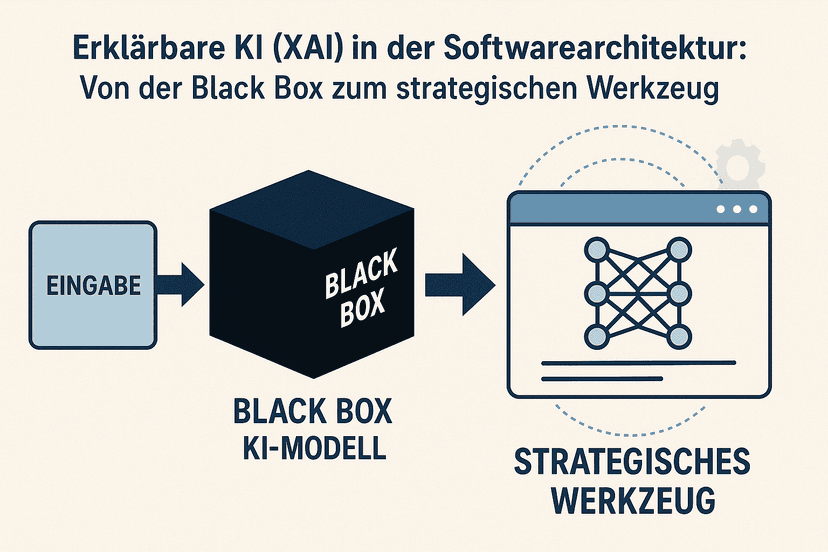

Welche Rolle spielen KI und Machine Learning im DQ Requirements Engineering?

Künstliche Intelligenz (KI) und Machine Learning (ML) revolutionieren zunehmend das DQ Requirements Engineering, indem sie manuelle Prozesse automatisieren, bei der Erkennung komplexer Muster helfen und proaktive Ansätze ermöglichen. Ihre Rolle umfasst mehrere Dimensionen: 1. **Automatisierte Identifikation von DQ-Anforderungen:

** * **Mustererkennung:

*

* ML-Algorithmen können in großen Datenmengen automatisch Muster, Anomalien und Ausreißer erkennen, die auf potenzielle DQ-Probleme hinweisen.

* **Vorschlagssysteme:

*

* KI kann basierend auf Datenstrukturen, Nutzungsmustern und historischen DQ-Problemen automatisch geeignete DQ-Regeln vorschlagen.

* **Priorisierung:

*

* Intelligente Algorithmen helfen bei der Bewertung der Kritikalität von DQ-Problemen und der Priorisierung von Anforderungen basierend auf Geschäftsauswirkungen. 2. **Erweiterte Datenprofilierung:

** * **Semantische Analyse:

*

* KI kann den Inhalt von Datenfeldern verstehen und semantische Beziehungen zwischen Daten erkennen, die über einfache syntaktische Regeln hinausgehen.

* **Kontextuelle Validierung:

*

* Erkennung von Werten, die zwar syntaktisch korrekt, aber im jeweiligen Kontext unplausibel sind (z.B. ein Geburtsdatum in der Zukunft).

* **Unstrukturierte Daten:

*

* Analyse von Text, Bildern und anderen unstrukturierten Daten, für die traditionelle Profilierungsmethoden nicht ausreichen. 3.

Wie unterscheidet sich die Definition von DQ-Anforderungen für Big Data von traditionellen Datenumgebungen?

Die Definition von Datenqualitätsanforderungen für Big-Data-Umgebungen erfordert einen angepassten Ansatz, der den besonderen Charakteristika dieser Datenlandschaften Rechnung trägt. Die wesentlichen Unterschiede und Anpassungen sind: 1. **Volumenbezogene Anpassungen:

** * **Stichprobenbasierte Ansätze:

*

* Bei enormen Datenmengen ist oft eine vollständige Prüfung nicht praktikabel. DQ-Anforderungen müssen statistische Stichproben- und Konfidenzintervalle berücksichtigen.

* **Performanzoptimierte Regeln:

*

* DQ-Anforderungen müssen so formuliert werden, dass sie effizient auf große Datenmengen anwendbar sind, ohne Verarbeitungsprozesse wesentlich zu verlangsamen.

* **Skalierbare Metriken:

*

* Kennzahlen müssen auch bei wachsenden Datenvolumina aussagekräftig und berechenbar bleiben. 2. **Varietätsbezogene Anpassungen:

** * **Strukturierte vs. unstrukturierte Daten:

*

* Für unstrukturierte Daten (Text, Bilder, Videos) sind andere DQ-Dimensionen und Metriken relevant als für strukturierte Daten.

* **Schemalose Datenbanken:

*

* In NoSQL-Umgebungen fehlen oft feste Schemata, was die Definition von Vollständigkeits- und Konsistenzanforderungen erschwert.

* **Polyglot Persistence:

*

* In Multi-Datenbank-Umgebungen müssen DQ-Anforderungen technologieübergreifend definiert und gemessen werden. 3. **Geschwindigkeitsbezogene Anpassungen:

** * **Echtzeit-DQ:

*

* Für Streaming-Daten müssen DQ-Anforderungen Aspekte wie die maximal tolerierbare Latenz für Qualitätsprüfungen berücksichtigen.

Wie beeinflusst das DQ Requirements Engineering die Total Cost of Ownership (TCO) eines Datenprojekts?

Ein effektives DQ Requirements Engineering kann die Total Cost of Ownership (TCO) eines Datenprojekts signifikant beeinflussen, sowohl durch Kosteneinsparungen als auch durch strategische Investitionen. Die Auswirkungen lassen sich in verschiedenen Phasen und Bereichen beobachten: **Kostensenkende Effekte:

** 1. **Vermeidung von Nacharbeiten und Korrekturen:

**

* Frühzeitige Definition klarer DQ-Anforderungen reduziert kostspielige Nachbesserungen in späteren Projektphasen.

* Studien zeigen, dass die Behebung von Fehlern in der Produktionsphase bis zu 100-mal teurer sein kann als in der Anforderungsphase. 2. **Reduzierung von Datenbereinigungsaufwänden:

**

* Präventive DQ-Maßnahmen auf Basis klarer Anforderungen minimieren kontinuierliche Bereinigungsaufwände.

* Automatisierte DQ-Kontrollen senken den manuellen Aufwand für Datenqualitätssicherung. 3. **Vermeidung von Fehlentscheidungen:

**

* Höhere Datenqualität durch präzise Anforderungen verringert das Risiko kostspieliger Fehlentscheidungen.

* Der finanzielle Impact von Geschäftsentscheidungen auf Basis schlechter Daten kann den Implementierungsaufwand für DQ um ein Vielfaches übersteigen. 4. **Effizientere Ressourcennutzung:

**

* Priorisierte DQ-Anforderungen fokussieren Ressourcen auf die geschäftlich relevantesten Aspekte.

* Vermeidung von "Overengineering" durch klare Abgrenzung der notwendigen Qualitätsniveaus. 5.

Wie verändert sich DQ Requirements Engineering in der Cloud?

Die Verlagerung von Dateninfrastrukturen in die Cloud verändert das DQ Requirements Engineering in mehreren Dimensionen. Cloud-spezifische Aspekte müssen bei der Definition, Implementierung und Überwachung von DQ-Anforderungen berücksichtigt werden: 1. **Architektonische Anpassungen:

** * **Multi-Service-Umgebungen:

*

* In Cloud-Umgebungen werden häufig verschiedene spezialisierte Services kombiniert (z.B. Storage, Datenbanken, Analytics). DQ-Anforderungen müssen service-übergreifend konsistent definiert werden.

* **Serverless Architektur:

*

* Bei ereignisgesteuerten, serverlosen Architekturen müssen DQ-Kontrollen in die einzelnen Funktionen integriert werden, statt an zentralen Datenzugriffspunkten zu stehen.

* **Microservices:

*

* Verteilte Verantwortlichkeiten für Daten erfordern klare DQ-Anforderungen an Service-Schnittstellen und API-Verträge. 2. **Shared Responsibility Model:

** * **Verantwortungsabgrenzung:

*

* Klare Definition, welche DQ-Anforderungen durch den Cloud-Provider erfüllt werden und welche in der Verantwortung des eigenen Unternehmens liegen.

* **Provider-SLAs:

*

* Einbeziehung der vom Provider garantierten Service Levels (Verfügbarkeit, Latenz, Datenverlustrisiko) in die DQ-Anforderungen.

* **Compliance-Anforderungen:

*

* Berücksichtigung der Möglichkeiten und Grenzen des Cloud-Providers bei der Erfüllung regulatorischer DQ-Anforderungen. 3. **Datenfluss und Integration:

** * **Hybrid-Cloud-Szenarien:

*

* Definition von DQ-Anforderungen für den Datenfluss zwischen On-Premise- und Cloud-Umgebungen.

* **Multi-Cloud-Strategien:

*

* Konsistente DQ-Anforderungen über verschiedene Cloud-Provider hinweg.

* **ETL vs.

Erfolgsgeschichten

Entdecken Sie, wie wir Unternehmen bei ihrer digitalen Transformation unterstützen

Generative KI in der Fertigung

Bosch

KI-Prozessoptimierung für bessere Produktionseffizienz

Fallstudie

Ergebnisse

Reduzierung der Implementierungszeit von AI-Anwendungen auf wenige Wochen

Verbesserung der Produktqualität durch frühzeitige Fehlererkennung

Steigerung der Effizienz in der Fertigung durch reduzierte Downtime

AI Automatisierung in der Produktion

Festo

Intelligente Vernetzung für zukunftsfähige Produktionssysteme

Fallstudie

Ergebnisse

Verbesserung der Produktionsgeschwindigkeit und Flexibilität

Reduzierung der Herstellungskosten durch effizientere Ressourcennutzung

Erhöhung der Kundenzufriedenheit durch personalisierte Produkte

KI-gestützte Fertigungsoptimierung

Siemens

Smarte Fertigungslösungen für maximale Wertschöpfung

Fallstudie

Ergebnisse

Erhebliche Steigerung der Produktionsleistung

Reduzierung von Downtime und Produktionskosten

Verbesserung der Nachhaltigkeit durch effizientere Ressourcennutzung

Digitalisierung im Stahlhandel

Klöckner & Co

Digitalisierung im Stahlhandel

Fallstudie

Ergebnisse

Über 2 Milliarden Euro Umsatz jährlich über digitale Kanäle

Ziel, bis 2022 60% des Umsatzes online zu erzielen

Verbesserung der Kundenzufriedenheit durch automatisierte Prozesse

Lassen Sie uns

Zusammenarbeiten!

Ist Ihr Unternehmen bereit für den nächsten Schritt in die digitale Zukunft? Kontaktieren Sie uns für eine persönliche Beratung.

Ihr strategischer Erfolg beginnt hier

Unsere Kunden vertrauen auf unsere Expertise in digitaler Transformation, Compliance und Risikomanagement

Bereit für den nächsten Schritt?

Vereinbaren Sie jetzt ein strategisches Beratungsgespräch mit unseren Experten

30 Minuten • Unverbindlich • Sofort verfügbar

Zur optimalen Vorbereitung Ihres Strategiegesprächs:

Ihre strategischen Ziele und Herausforderungen

Gewünschte Geschäftsergebnisse und ROI-Erwartungen

Aktuelle Compliance- und Risikosituation

Stakeholder und Entscheidungsträger im Projekt

Bevorzugen Sie direkten Kontakt?

Direkte Hotline für Entscheidungsträger

Strategische Anfragen per E-Mail

Detaillierte Projektanfrage

Für komplexe Anfragen oder wenn Sie spezifische Informationen vorab übermitteln möchten