Datenprodukte entwickeln, validieren und skalieren

Datenproduktentwicklung

Die Entwicklung erfolgreicher Datenprodukte erfordert mehr als nur technisches Know-how. Wir begleiten Sie durch alle Phasen der Produktentwicklung – von der ersten Idee über die Konzeption und Validierung bis hin zur Markteinführung und kontinuierlichen Optimierung.

- ✓Kundenzentrierte Entwicklung mit Fokus auf echten Mehrwert

- ✓Agile Methoden für schnelles Lernen und Anpassen

- ✓Iterative Validierung und Testing mit Zielkunden

- ✓Kombination aus Business-, Daten- und Technologie-Expertise

Ihr Erfolg beginnt hier

Bereit für den nächsten Schritt?

Schnell, einfach und absolut unverbindlich.

Zur optimalen Vorbereitung:

- Ihr Anliegen

- Wunsch-Ergebnis

- Bisherige Schritte

Oder kontaktieren Sie uns direkt:

Zertifikate, Partner und mehr...

Erfolgreiche Datenproduktentwicklung von Anfang an

Unsere Stärken

- Erfolgreiche Entwicklung zahlreicher Datenprodukte für verschiedene Branchen

- Interdisziplinäre Teams aus Data Scientists, UX-Designern und Produktmanagern

- Evidenzbasierte Entwicklungsmethodik mit Fokus auf Lernen und Anpassen

- Umfassende Erfahrung mit Datenarchitekturen und modernen Entwicklungstechnologien

⚠

Expertentipp

Der Erfolg von Datenprodukten hängt wesentlich von der frühen und kontinuierlichen Einbindung potenzieller Nutzer ab. Unsere Erfahrung zeigt, dass die iterative Validierung von Hypothesen mit Zielkunden nicht nur die Produktentwicklung beschleunigt, sondern auch das Risiko kostspieliger Fehlentwicklungen deutlich reduziert. Besonders wichtig ist dabei, nicht nur nach Feature-Wünschen zu fragen, sondern tiefer liegende Probleme und Bedürfnisse zu verstehen.

ADVISORI in Zahlen

11+

Jahre Erfahrung

120+

Mitarbeiter

520+

Projekte

Unsere Methodik für die Datenproduktentwicklung folgt einem strukturierten, aber flexiblen Prozess, der auf bewährten agilen Praktiken basiert und speziell für die Besonderheiten datengetriebener Produkte optimiert wurde.

Unser Vorgehen

1

Phase 1

Phase 1: Exploration – Identifikation von Opportunitäten, Definition von Hypothesen, First-Principles-Thinking, Analyse von Datenbeständen

2

Phase 2

Phase 2: Konzeption – Customer Value Discovery, Produktdefinition, Datenarchitektur-Planung, Geschäftsmodellentwicklung

3

Phase 3

Phase 3: Prototyping – Entwicklung von Minimum Viable Data Products, Validierung von Hypothesen, Nutzerfeedback-Integration

4

Phase 4

Phase 4: Entwicklung – Implementierung von Datenpipelines, Entwicklung von Algorithmen und Modellen, UX-Design, Backend- und Frontend-Entwicklung

5

Phase 5

Phase 5: Markteinführung und Skalierung – Release-Management, A/B-Testing, Performance-Monitoring, iterative Optimierung

"Die erfolgreiche Entwicklung von Datenprodukten erfordert eine enge Verzahnung von Datenexpertise, Produktentwicklungskompetenz und Domänenwissen. In unseren Projekten zeigt sich immer wieder, dass der Schlüssel zum Erfolg in der kontinuierlichen Validierung von Annahmen und der iterativen Verfeinerung liegt. Datenprodukte, die echte Probleme lösen und dabei eine hervorragende User Experience bieten, haben das Potenzial, ganze Märkte zu transformieren."

Asan Stefanski

Head of Digital Transformation

Expertise & Erfahrung:

11+ Jahre Erfahrung, Studium Angewandte Informatik, Strategische Planung und Leitung von KI-Projekten, Cyber Security, Secure Software Development, AI

Unsere Dienstleistungen

Wir bieten Ihnen maßgeschneiderte Lösungen für Ihre digitale Transformation

Datenprodukt-Ideation und Konzeption

Entwicklung innovativer und marktrelevanter Datenprodukt-Ideen und deren Ausarbeitung zu tragfähigen Konzepten. Wir kombinieren kreative Methoden mit systematischer Markt- und Datenanalyse, um Opportunitäten zu identifizieren und vielversprechende Konzepte zu entwickeln.

- Strukturierte Ideation-Workshops mit bewährten Kreativitätstechniken

- Systematische Bewertung und Priorisierung von Produktideen

- Entwicklung von Value Propositions und Zielgruppen-Personas

- Ausarbeitung von Produktvision und strategischer Roadmap

Datenprodukt-Design und Prototyping

Gestaltung nutzerfreundlicher Datenprodukte und Entwicklung testbarer Prototypen. Wir verfolgen einen nutzerzentrierten Designansatz, der die spezifischen Anforderungen datengetriebener Produkte berücksichtigt und frühzeitiges Feedback ermöglicht.

- User Research und Journey Mapping für datengetriebene Produkte

- Information Architecture und UX-Design für komplexe Datenvisualisierungen

- Rapid Prototyping mit speziellen Tools für Datenprodukte

- Usability-Tests und iterative Designverbesserung

Datenprodukt-Entwicklung und Implementierung

Technische Umsetzung von Datenprodukten mit modernen Technologien und Best Practices. Wir entwickeln skalierbare, robuste und wartbare Datenprodukte unter Berücksichtigung aller relevanten Qualitätsaspekte und technischen Anforderungen.

- Entwicklung skalierbarer Datenpipelines und ETL-Prozesse

- Implementierung von Analytics-Engines und ML-Modellen

- Frontend-Entwicklung mit optimaler User Experience

- API-Design und Integration in bestehende Systemlandschaften

Datenprodukt-Testing und Qualitätssicherung

Umfassende Validierung und Optimierung von Datenprodukten hinsichtlich Funktionalität, Performance und Nutzerakzeptanz. Wir stellen sicher, dass Ihre Datenprodukte höchsten Qualitätsansprüchen genügen und die definierten Business-Ziele erreichen.

- Systematisches Testing von Datenqualität und Algorithmen-Performance

- A/B-Testing und Experiment-Design für datengetriebene Features

- Validierung durch Beta-Tester und Early Adopters

- Performance-Optimierung und Skalierbarkeits-Tests

Unsere Kompetenzen im Bereich Datenprodukte

Wählen Sie den passenden Bereich für Ihre Anforderungen

API Produktentwicklung

Unsere API Produktentwicklung unterstützt Sie dabei, Datenassets und Services über standardisierte Schnittstellen als marktfähige API-Produkte bereitzustellen. Wir begleiten Sie von der strategischen Planung über API-Design und Developer Experience bis hin zur nachhaltigen Monetarisierung Ihrer API-Ökosysteme.

Data Mesh Architecture

Wie transformieren Unternehmen monolithische Datenarchitekturen in skalierbare, dezentrale Systeme? Mit Data Mesh Architektur. ADVISORI implementiert Domain Ownership, Self-Serve Data Infrastructure und Federated Governance — damit Ihre Fachbereiche Daten als Produkt eigenverantwortlich bereitstellen und nutzen.

Data as a Service

Transformieren Sie Ihre Datenbestände in strategische Produkte und Services. Wir unterstützen Sie bei der Konzeption und Implementierung zukunftsfähiger DaaS-Lösungen, die Ihren Kunden, Partnern und internen Abteilungen kontrollierten Datenzugriff über standardisierte APIs ermöglichen – bei maximaler Sicherheit, Compliance und Skalierbarkeit.

Monetarisierungsmodelle

Welches Monetarisierungsmodell passt zu Ihrem Datenprodukt? Ob Subscription, Pay-per-Use, Freemium oder Value-Based Pricing — wir entwickeln mit Ihnen die optimale Preisstrategie, die den echten Kundennutzen Ihrer Daten widerspiegelt und nachhaltige Umsatzquellen erschließt.

Häufig gestellte Fragen zur Datenproduktentwicklung

Was unterscheidet die Entwicklung von Datenprodukten von klassischer Produktentwicklung?

Die Entwicklung von Datenprodukten unterscheidet sich in wesentlichen Aspekten von der klassischen Produktentwicklung, was einen spezialisierten Ansatz erfordert. Ein tiefes Verständnis dieser Unterschiede ist entscheidend für den Erfolg von Datenprodukt-Initiativen.

🧩 Fundamentale Unterschiede im Produktkern

•

Wertschöpfung durch Daten: Der primäre Wert liegt in Daten, Analysen und Insights statt in physischen Eigenschaften

•

Komplexe Infrastruktur: Benötigt Datenpipelines, Analysemodelle und Delivery-Mechanismen

•

Dynamische Ergebnisse: Resultate können variieren und sich mit neuen Daten verändern

•

Netzwerkeffekte: Häufig steigt der Wert mit Datenvolumen und Nutzeranzahl

•

Permanente Evolution: Kontinuierliche Verbesserung durch neue Daten und Nutzerfeedback

🔄 Abweichende Entwicklungsprozesse

•

Data Discovery: Frühe Exploration und Validierung von Daten als kritischer Schritt

•

Modellevaluierung: Iterative Verbesserung von Algorithmen und Vorhersagemodellen

•

Dual-Track-Entwicklung: Parallele Weiterentwicklung von Datenmodellen und Nutzererfahrung

•

Continuous Training: Laufende Aktualisierung und Verbesserung von ML-Modellen

•

Datenqualitätssicherung: Besondere Maßnahmen für Datenvalidierung und -bereinigung

🛠 ️ Spezifische Herausforderungen

•

Daten als kritischer Engpass: Verfügbarkeit, Qualität und Zugang zu relevanten Daten

•

Komplexe Evaluierung: Schwierigere Bewertung der Produktqualität und Performance

•

.

Welche Methoden haben sich für die Entwicklung erfolgreicher Datenprodukte bewährt?

Die Entwicklung erfolgreicher Datenprodukte erfordert einen spezialisierten methodischen Ansatz, der klassische Produktentwicklungspraktiken mit datenzentrierten Methoden kombiniert. Mehrere Ansätze haben sich in der Praxis besonders bewährt.

🔄 Agile und iterative Ansätze

•

Data Product Discovery: Strukturierte Exploration von Daten, Kundenproblemen und Lösungshypothesen

•

Lean Data Product Development: Schnelle Erstellung und Validierung von Minimal Viable Data Products

•

Dual-Track Agile: Parallele Entwicklung von Datenmodellen und Nutzeroberflächen

•

Data-Driven Sprints: Kurze Entwicklungszyklen mit datenbasierten Entscheidungen

•

Continuous Experimentation: Laufende A/B-Tests und Hypothesenvalidierung

🎯 Nutzerorientierte Methoden

•

Jobs-to-be-Done für Datenprodukte: Identifikation der eigentlichen Nutzeraufgaben und -ziele

•

Data User Personas: Entwicklung spezifischer Personenprofile für Datenproduktnutzer

•

User Journey Mapping: Abbildung der Nutzerreise im Kontext datengetriebener Entscheidungen

•

Data Experience Design: Gestaltung intuitiver Nutzererfahrungen für komplexe Datenanwendungen

•

Prototyping mit realen Daten: Frühzeitige Tests mit echten oder synthetischen Datensätzen

📊 Datenspezifische Techniken

•

Data Opportunity Assessment: Systematische Bewertung des Potenzials verfügbarer Daten

•

Algorithmic Thinking Workshops: Kollaborative Entwicklung von Analysemethoden

•

Model Evaluation Framework: Standardisierte Bewertung der Modellqualität und -performance.

Was macht ein Minimum Viable Data Product (MVDP) aus und wie entwickelt man es?

Ein Minimum Viable Data Product (MVDP) ist eine frühe Version eines Datenprodukts mit gerade genug Funktionalität, um echten Nutzwert zu liefern und validierbare Erkenntnisse für die Weiterentwicklung zu generieren. Im Vergleich zu klassischen MVPs weist es datenspezifische Besonderheiten auf.

🎯 Kernmerkmale eines MVDP

•

Fokussierte Werthypothese: Klar definierter Nutzen basierend auf Daten und Analysen

•

Grundlegende Datenpipeline: Minimale, aber funktionale Datenerfassung und -verarbeitung

•

Kernalgorithmus: Einfache, aber wirkungsvolle Analyselogik oder Modelle

•

Essentielle Nutzerschnittstelle: Minimale, aber nutzbare Präsentation der Ergebnisse

•

Feedback-Mechanismen: Möglichkeiten zum Sammeln von Nutzerreaktionen und Metriken

🔄 Entwicklungsschritte für ein MVDP

•

Problem-Solution Fit: Validierung der Kernprobleme und Lösungsansätze mit Zielkunden

•

Data Assessment: Bewertung der verfügbaren Daten und deren Eignung für das Produkt

•

Hypothesenformulierung: Definition messbarer Annahmen für Nutzerverhalten und Produktwert

•

Simplest Viable Algorithm: Entwicklung einfacher, aber effektiver analytischer Methoden

•

Rapid Prototyping: Schnelle Umsetzung mit Fokus auf die wertvollsten Funktionen

⚖ ️ Trade-offs und Balance

•

Genauigkeit vs. Geschwindigkeit: Akzeptanz anfänglicher Einschränkungen bei der Modellqualität

•

Manuelle vs.

Wie integriert man User Experience (UX) Design in die Entwicklung von Datenprodukten?

Die Integration von User Experience (UX) Design in die Entwicklung von Datenprodukten ist entscheidend für deren Erfolg, da selbst die fortschrittlichsten Datenanalysen wertlos bleiben, wenn sie nicht nutzerfreundlich zugänglich gemacht werden. Datenprodukten kommt dabei eine besondere Herausforderung zu, da sie komplexe Informationen verständlich präsentieren müssen.

🎯 Besonderheiten des UX Designs für Datenprodukte

•

Komplexitätsreduktion: Vereinfachung komplexer Daten und Analysen ohne Informationsverlust

•

Adaptive Interfaces: Anpassungsfähige Darstellungen für unterschiedliche Nutzergruppen

•

Decision Support: Fokus auf Entscheidungsunterstützung statt reiner Informationsdarstellung

•

Erklärbarkeit: Transparente Vermittlung der Datenherkunft und Analysemethoden

•

Vertrauensbildung: Design-Elemente zur Förderung des Vertrauens in Daten und Ergebnisse

🧪 UX Research für Datenprodukte

•

Nutzungskontextanalyse: Verständnis des Entscheidungsumfelds der Zielgruppe

•

Mental Models Mapping: Erfassung der Denk- und Interpretationsmuster von Nutzern

•

Data Literacy Assessment: Bewertung des Datenverständnisses der Zielgruppe

•

Job-to-be-Done Interviews: Identifikation der eigentlichen Aufgaben und Ziele

•

Contextual Inquiry: Beobachtung der Datennutzung im realen Arbeitsumfeld

📊 Designprinzipien für Datenprodukte

•

Progressive Disclosure: Schichtweise Offenlegung von Komplexität je nach Bedarf

•

Actionable Insights: Fokus.

Welche typischen Herausforderungen treten bei der Datenproduktentwicklung auf und wie überwindet man sie?

Die Entwicklung von Datenprodukten ist mit spezifischen Herausforderungen verbunden, die über die üblichen Schwierigkeiten der Produktentwicklung hinausgehen. Ein proaktiver Umgang mit diesen Hürden ist entscheidend für den Erfolg von Datenprodukt-Initiativen.

🔍 Datenbezogene Herausforderungen

•

Datenqualitätsmängel: Unvollständige, fehlerhafte oder verzerrte Datensätze

•

Datenzugangsbarrieren: Schwierigkeiten beim Zugriff auf relevante Datenquellen

•

Datenintegrationsprobleme: Komplexe Verknüpfung heterogener Datenbestände

•

Datenmengenbeschränkungen: Unzureichende Datenvolumina für zuverlässige Analysen

•

Datenaktualität: Herausforderungen bei der Beschaffung aktueller Daten Lösungsansätze:

•

Frühzeitige Datenqualitätsassessments und Bereinigungsprozesse

•

Etablierung klarer Data Governance und Zugriffsregelungen

•

Aufbau flexibler Datenintegrationsarchitekturen

•

Strategien zur Datenergänzung und synthetischen Datengenerierung

•

Implementierung effizienter Datenpipelines für zeitnahe Updates

🧪 Modellierungsherausforderungen

•

Komplexitäts-Performance-Tradeoff: Balance zwischen Modellgenauigkeit und Effizienz

•

Overfitting: Überspezialisierung auf Trainingsdaten mit schlechter Generalisierung

•

Modelldrift: Nachlassende Modellqualität durch sich ändernde Datenmuster

•

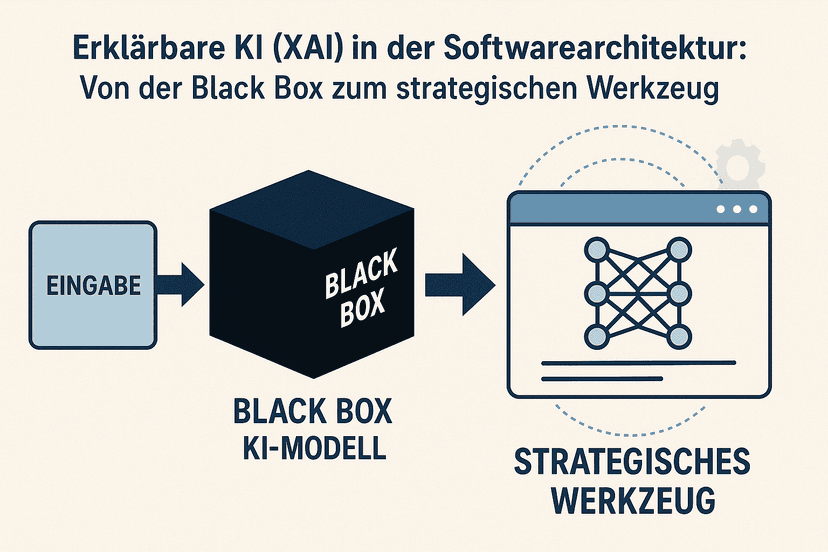

Erklärbarkeit: Schwierigkeiten bei der Nachvollziehbarkeit komplexer Modelle

•

Featurekomplexität: Auswahl und Engineering relevanter Merkmale Lösungsansätze:

•

Strukturierte Modellentwicklung mit klaren Evaluationskriterien

•

Robuste Validierungsmethoden wie Cross-Validation und Out-of-Time-Testing

•

Implementierung von Monitoring und automatischem Retraining

•

Einsatz erklärbarer KI-Methoden.

Wie gestaltet man erfolgreiche Datenvisualisierungen für Datenprodukte?

Datenvisualisierungen sind ein zentraler Bestandteil erfolgreicher Datenprodukte, da sie komplexe Zusammenhänge verständlich machen und Nutzern helfen, Erkenntnisse zu gewinnen und fundierte Entscheidungen zu treffen. Die Gestaltung effektiver Visualisierungen erfordert mehr als nur technisches Wissen – sie kombiniert Datenexpertise mit Design-Kompetenz und Domänenverständnis.

📊 Grundprinzipien effektiver Datenvisualisierung

•

Klarheit vor Komplexität: Fokus auf zentrale Botschaften statt Datenüberfrachtung

•

Kontextbezogene Darstellung: Visualisierungen im Kontext der Nutzerentscheidungen gestalten

•

Konsistente visuelle Sprache: Einheitliche Farbcodierung, Icons und Layouts

•

Intuitive Interaktivität: Gezielte Interaktionsmöglichkeiten mit klarem Mehrwert

•

Zugänglichkeit: Berücksichtigung verschiedener Datenkompetenzen und Barrierefreiheit

🎨 Visuelle Design-Strategien

•

Visuelle Hierarchie: Hervorhebung wichtiger Informationen durch Größe, Farbe und Position

•

Reduzierung kognitiver Last: Vermeidung visueller Überlastung und Ablenkungen

•

Gestaltgesetze: Nutzung von Nähe, Ähnlichkeit und Kontinuität für intuitive Erfassung

•

Farbschemata: Zweckmäßige Farbauswahl für Kategorisierung, Hervorhebung und Emotionen

•

Typografie: Leserliche und hierarchische Textgestaltung für Beschriftungen und Erklärungen

📱 Anpassung an Nutzungskontext und -geräte

•

Responsive Design: Anpassungsfähigkeit an verschiedene Bildschirmgrößen und -formate

•

Progressive Disclosure: Stufenweise Darstellung von Details je.

Wie implementiert man ein effektives Product Management für Datenprodukte?

Das Produktmanagement für Datenprodukte erfordert eine spezifische Herangehensweise, die klassische Produktmanagement-Praktiken mit datenspezifischen Aspekten kombiniert. Ein effektives Produktmanagement ist entscheidend, um Datenprodukte zu entwickeln, die echten Mehrwert bieten und erfolgreich am Markt bestehen.

👥 Rollen und Verantwortlichkeiten

•

Data Product Manager: Verantwortlich für Vision, Roadmap und Geschäftserfolg des Datenprodukts

•

Data Domain Owner: Experte für die fachlichen Aspekte und Nutzungskontexte der Daten

•

Data Scientist Liaison: Verbindung zu den analytischen und modellierenden Teams

•

UX-Spezialist für Datenprodukte: Verantwortlich für nutzerfreundliche Dateninteraktionen

•

Technical Product Owner: Fokus auf technische Implementierung und Architektur

🎯 Produktstrategie und Vision

•

Datenprodukt-Vision: Klare Zukunftsvorstellung mit messbarem Wertversprechen

•

Marktpositionierung: Einordnung im Wettbewerbsumfeld und Differenzierungsmerkmale

•

Zielgruppendefinition: Präzise Charakterisierung der primären Nutzergruppen

•

Roadmap-Entwicklung: Strategische Planung der Produktevolution

•

Metriken-Framework: Definition von Erfolgsmetriken und KPIs für das Datenprodukt

🔄 Agile Entwicklungsprozesse für Datenprodukte

•

Dual-Track Agile: Parallele Discovery- und Delivery-Zyklen

•

Data-focused User Stories: Anforderungsformulierung mit Datenfokus

•

Minimal Viable Data Products: Inkrementelle Entwicklung mit Fokus auf Kerndaten

•

Feedback Loops:.

Wie entwickelt man skalierbare Architekturen für Datenprodukte?

Die Entwicklung skalierbarer Architekturen ist entscheidend für den langfristigen Erfolg von Datenprodukten. Eine durchdachte Architektur ermöglicht nicht nur die Bewältigung wachsender Datenmengen und Nutzerzahlen, sondern auch die flexible Weiterentwicklung des Produkts und die Integration neuer Technologien.

🏗 ️ Architekturprinzipien für Datenprodukte

•

Modularität: Lose gekoppelte Komponenten für unabhängige Entwicklung und Skalierung

•

Layered Architecture: Klare Trennung von Datenerfassung, -verarbeitung, -analyse und -präsentation

•

Stateless Design: Zustandslose Komponenten für horizontale Skalierbarkeit

•

Resilience by Design: Fehlertoleranz und Selbstheilungsmechanismen

•

API-first: Definierte Schnittstellen als Basis für flexible Integration

•

Observability: Umfassendes Monitoring und Logging für Transparenz und Diagnose

☁ ️ Cloud-native Ansätze

•

Microservices: Fein granulare, spezialisierte Dienste für einzelne Funktionalitäten

•

Serverless Computing: Event-getriebene, automatisch skalierende Funktionen

•

Containerisierung: Konsistente Laufzeitumgebungen mit Docker und Kubernetes

•

Managed Services: Nutzung cloud-basierter Dienste für Standardkomponenten

•

Infrastructure as Code: Automatisierte Bereitstellung und Konfiguration

•

Multi-Cloud Strategy: Flexibilität durch Cloud-übergreifende Architekturen

📊 Datenarchitektur-Komponenten

•

Data Ingestion: Skalierbare Mechanismen zur Datenerfassung und -integration

•

Data Lake/Warehouse: Flexible Speicherung und Organisation großer Datenmengen.

Wie validiert und testet man Datenprodukte effektiv?

Die Validierung und das Testing von Datenprodukten erfordert spezifische Ansätze, die über konventionelle Softwaretests hinausgehen. Ein umfassendes Test- und Validierungskonzept berücksichtigt sowohl die technischen Aspekte als auch die Nutzerperspektive und den geschäftlichen Wertbeitrag.

🧪 Testtypen und -ebenen

•

Datenqualitätstests: Überprüfung von Vollständigkeit, Genauigkeit und Konsistenz

•

Modellvalidierung: Bewertung der Modellperformance und Verallgemeinerungsfähigkeit

•

Funktionale Tests: Überprüfung der Kernfunktionalitäten und Nutzerinteraktionen

•

Performance-Tests: Bewertung von Antwortzeiten, Durchsatz und Skalierbarkeit

•

Integrationstests: Validierung der Zusammenarbeit aller Komponenten

•

End-to-End-Tests: Überprüfung vollständiger Nutzerszenarien und Workflows

📊 Validierung der analytischen Komponenten

•

Cross-Validation: Bewertung der Modellperformance auf verschiedenen Datensätzen

•

A/B Testing: Vergleich verschiedener Algorithmen oder Analyseansätze

•

Holdout Validation: Überprüfung mit zurückgehaltenen, ungesehenen Daten

•

Backtesting: Retrospektive Anwendung auf historische Daten und Vergleich mit bekannten Ergebnissen

•

Feature Importance Analysis: Bewertung der Relevanz einzelner Datenmerkmale

•

Sensitivity Analysis: Prüfung der Robustheit gegenüber Datenvariationen

👥 Nutzer- und Business-Validierung

•

User Acceptance Testing: Überprüfung durch reale Nutzer in authentischen Szenarien

•

Expert Review: Bewertung durch Domänenexperten und Data Scientists

•

.

Wie etabliert man Data Governance für die Datenproduktentwicklung?

Data Governance ist ein kritischer Erfolgsfaktor für die nachhaltige Entwicklung von Datenprodukten. Sie schafft den organisatorischen und prozessualen Rahmen für die verantwortungsvolle, konforme und hochwertige Nutzung von Daten im gesamten Lebenszyklus der Produktentwicklung.

🏛 ️ Governance-Strukturen und Verantwortlichkeiten

•

Data Governance Board: Übergreifendes Gremium für strategische Entscheidungen

•

Data Owners: Fachliche Verantwortung für Datendomänen und -qualität

•

Data Stewards: Operative Verwaltung und Pflege spezifischer Datenbereiche

•

Data Product Managers: Verantwortung für datenproduktspezifische Governance

•

Data Architects: Sicherstellung konsistenter technischer Standards

•

Privacy Officers: Überwachung datenschutzrechtlicher Compliance

📋 Richtlinien und Standards

•

Datenqualitätsstandards: Definierte Kriterien für Vollständigkeit, Genauigkeit, Aktualität

•

Metadatenmanagement: Einheitliche Dokumentation von Datenquellen und -transformationen

•

Data Lineage: Nachvollziehbare Dokumentation der Datenherkunft und -verarbeitung

•

Zugriffsrichtlinien: Klare Regelungen für Datenzugriff und -nutzung

•

Retention Policies: Festlegungen zur Speicherdauer und Archivierung

•

Datensicherheitsstandards: Anforderungen an Verschlüsselung und Schutzmaßnahmen

🔄 Governance-Prozesse für Datenprodukte

•

Data Impact Assessment: Bewertung von Datenrisiken und -chancen neuer Produkte

•

Data Quality Management: Kontinuierliche Überwachung und Verbesserung der Datenqualität

•

Change Management:.

Wie implementiert man effektive Frontend-Backend-Integration für Datenprodukte?

Die erfolgreiche Entwicklung von Datenprodukten erfordert eine nahtlose Integration zwischen Frontend und Backend. Diese Integration ist besonders anspruchsvoll, da sie die Brücke zwischen komplexen Datenverarbeitungsprozessen und intuitiven Benutzeroberflächen schlägt.

🔄 Architekturelle Ansätze

•

API-First Design: Definition klarer Schnittstellen vor der Implementierung

•

Backend for Frontend (BFF): Spezialisierte Backend-Services für Frontend-Anforderungen

•

GraphQL: Flexible Datenabfragen mit präziser Spezifikation benötigter Daten

•

REST APIs: Standardisierte Schnittstellen für ressourcenorientierte Interaktionen

•

Websockets: Bidirektionale Kommunikation für Echtzeit-Datenaktualisierungen

•

Server-Sent Events: Unidirektionale Ereignisstreams für Live-Updates

⚡ Performance-Optimierung

•

Response Caching: Zwischenspeicherung häufig angefragter Daten

•

Pagination: Seitenweise Übertragung großer Datenmengen

•

Lazy Loading: Bedarfsgesteuerte Nachladen von Daten

•

Aggregation: Serverseitige Datenverdichtung für effiziente Übertragung

•

Compression: Datenkomprimierung zur Reduzierung der Übertragungsgröße

•

Request Batching: Bündelung mehrerer Anfragen zur Reduzierung von Netzwerkaufwand

🧩 Datenformatierung und -transformation

•

Data Transfer Objects (DTOs): Spezialisierte Objekte für die Datenübertragung

•

Transformation Layer: Anpassung der Backend-Daten an Frontend-Bedürfnisse

•

Response Shaping: Dynamische Anpassung der API-Antworten je nach Kontext

•

Standardisierte Formate: Konsistente Datenstrukturen für vereinfachte.

Wie fördert man effektive Zusammenarbeit zwischen technischen und fachlichen Teams bei der Datenproduktentwicklung?

Die erfolgreiche Entwicklung von Datenprodukten erfordert eine enge Zusammenarbeit zwischen technischen Teams (Data Scientists, Entwickler) und fachlichen Teams (Domänenexperten, Produktmanager). Die Überbrückung dieser unterschiedlichen Perspektiven ist entscheidend für den Erfolg und stellt gleichzeitig eine zentrale Herausforderung dar.

🤝 Organisationsmodelle für erfolgreiche Zusammenarbeit

•

Cross-funktionale Teams: Integration von technischen und fachlichen Rollen in einem Team

•

Embedded Expertise: Einbettung von Domänenexperten in technische Teams

•

Liaison-Rollen: Spezialisierte Vermittler zwischen technischen und fachlichen Bereichen

•

Matrix-Strukturen: Kombination von fachlicher und technischer Berichtslinien

•

Communities of Practice: Bereichsübergreifende Expertengruppen für Wissensaustausch

•

Rotation Programs: Zeitweise Mitarbeit in anderen Bereichen zum Perspektivwechsel

🗣 ️ Kommunikation und gemeinsame Sprache

•

Glossar und Taxonomie: Einheitliche Definition von Fachbegriffen und Konzepten

•

Visualisierungen: Grafische Darstellungen zum Überbrücken von Verständnislücken

•

Regelmäßige Rituale: Etablierte Formate für strukturierten Austausch

•

Dokumentationsstandards: Klare Richtlinien für verständliche Dokumentation

•

Knowledge Sharing: Systematischer Wissenstransfer zwischen Experten

•

Translation Layer: Übersetzung technischer Konzepte in Geschäftssprache und umgekehrt

🧩 Methoden und Prozesse

•

Gemeinsame Discovery-Workshops: Kollaborative Exploration von Problemen und.

Wie erfolgt die Integration von Machine Learning in Datenprodukte?

Die Integration von Machine Learning (ML) in Datenprodukte kann deren Wert und Differenzierung erheblich steigern. Eine durchdachte und systematische Herangehensweise ist entscheidend, um ML-Komponenten erfolgreich zu implementieren und kontinuierlich zu verbessern.

🎯 Anwendungsfälle für ML in Datenprodukten

•

Predictive Features: Vorhersage zukünftiger Trends und Ereignisse

•

Recommendation Systems: Personalisierte Empfehlungen und Vorschläge

•

Anomaly Detection: Automatische Identifikation ungewöhnlicher Muster

•

Natural Language Processing: Textverständnis und -generierung

•

Computer Vision: Bildanalyse und -erkennung

•

Automated Insights: Automatische Generierung von Erkenntnissen

•

Data Enrichment: KI-gestützte Anreicherung und Veredelung von Daten

🔄 ML Development Lifecycle

•

Problem Framing: Präzise Definition des zu lösenden Problems

•

Data Collection: Beschaffung relevanter Trainings- und Validierungsdaten

•

Feature Engineering: Identifikation und Transformation relevanter Merkmale

•

Model Selection: Auswahl geeigneter Algorithmen und Architekturen

•

Training & Evaluation: Modelltraining und Performance-Bewertung

•

Deployment: Integration des Modells in die Produktionsumgebung

•

Monitoring & Retraining: Kontinuierliche Überwachung und Aktualisierung

🏗 ️ Architekturelle Integrationsansätze

•

API-based Integration: ML-Modelle als eigenständige Services

•

Embedded Models: Integration direkt in Anwendungskomponenten.

Wie gestaltet man Deployment und Operations für Datenprodukte?

Ein durchdachtes Deployment und effiziente Operations sind entscheidend für den nachhaltigen Erfolg von Datenprodukten. Im Vergleich zu traditioneller Software bringen Datenprodukte spezifische Herausforderungen mit sich, die besondere Ansätze für Bereitstellung und Betrieb erfordern.

🚀 Deployment-Strategien für Datenprodukte

•

Continuous Deployment: Automatisierte Bereitstellung von Code- und Modelländerungen

•

Blue-Green Deployment: Parallelbetrieb zweier Produktivumgebungen für risikoarme Updates

•

Canary Releases: Schrittweise Einführung neuer Versionen für ausgewählte Nutzergruppen

•

Feature Flags: Selektive Aktivierung neuer Funktionalitäten

•

Shadow Deployment: Parallele Ausführung neuer Versionen ohne Nutzerauswirkung

•

Versioning Strategy: Klare Versionierungsregeln für APIs und Modelle

⚙ ️ Infrastruktur und Plattformen

•

Container Orchestration: Verwaltung von Containerinfrastrukturen mit Kubernetes

•

Serverless Architecture: Event-gesteuerte, automatisch skalierende Funktionen

•

CI/CD Pipelines: Automatisierte Build-, Test- und Deployment-Prozesse

•

Infrastructure as Code: Deklarative Definition der Infrastruktur

•

Multi-Environment Setup: Entwicklungs-, Test-, Staging- und Produktionsumgebungen

•

Disaster Recovery: Strategien für Datensicherung und Wiederherstellung

📊 Monitoring und Observability

•

Performance Monitoring: Überwachung von Systemleistung und Antwortzeiten

•

Data Quality Monitoring: Kontinuierliche Prüfung der Datenqualität

•

Model Performance Tracking:.

Welche Sicherheitsaspekte müssen bei der Entwicklung von Datenprodukten berücksichtigt werden?

Die Entwicklung sicherer Datenprodukte erfordert eine umfassende Berücksichtigung verschiedener Sicherheitsaspekte. Aufgrund der besonderen Sensibilität von Daten und der komplexen Architektur von Datenprodukten sind spezifische Sicherheitsmaßnahmen auf mehreren Ebenen notwendig.

🔒 Datensicherheit und Datenschutz

•

Datenverschlüsselung: Schutz sensibler Daten in Ruhe und während der Übertragung

•

Anonymisierung/Pseudonymisierung: Verfahren zur Reduzierung von Personenbezug

•

Datenklassifizierung: Einstufung von Daten nach Schutzbedarf

•

Zugriffskontrollen: Granulare Rechtesteuerung auf Datensatzebene

•

Data Lineage: Nachvollziehbarkeit der Datenherkunft und -verarbeitung

•

Privacy by Design: Integration von Datenschutzprinzipien von Beginn an

🛡 ️ Anwendungssicherheit

•

Authentifizierung: Robuste Mechanismen zur Benutzeridentifikation

•

Autorisierung: Kontextbezogene Zugriffsrechte für Funktionen und Daten

•

Input Validation: Umfassende Prüfung und Bereinigung von Eingabedaten

•

Output Encoding: Sichere Ausgabe von Daten zur Vermeidung von Injection-Angriffen

•

API Security: Schutz von Programmschnittstellen vor Missbrauch

•

Secure Development Lifecycle: Integration von Sicherheitspraktiken in den Entwicklungsprozess

🌐 Infrastruktur- und Netzwerksicherheit

•

Network Segmentation: Logische Trennung verschiedener Systemkomponenten

•

Secure Configuration: Absicherung aller Infrastrukturkomponenten

•

Container Security: Spezifische Schutzmaßnahmen für containerisierte Umgebungen

•

Cloud Security: Anpassung.

Wie entwickelt man kundenorientierte Datenprodukte, die echten Mehrwert liefern?

Die Entwicklung kundenorientierter Datenprodukte, die echten Mehrwert liefern, erfordert einen systematischen Ansatz, der die Nutzerbedürfnisse in jeder Phase des Entwicklungsprozesses in den Mittelpunkt stellt. Erfolgreiche Datenprodukte lösen reale Probleme und schaffen spürbare Vorteile für ihre Anwender.

🔍 Nutzerverständnis und Bedarfsanalyse

•

Tiefgehende User Research: Qualitative und quantitative Erforschung der Zielgruppe

•

Jobs-to-be-Done Framework: Identifikation der eigentlichen Aufgaben und Ziele der Nutzer

•

Pain Point Analysis: Systematische Erfassung und Priorisierung von Problemfeldern

•

Customer Journey Mapping: Visualisierung der Nutzererfahrung im Gesamtkontext

•

Stakeholder Interviews: Strukturierte Gespräche mit allen relevanten Interessengruppen

•

Contextual Inquiry: Beobachtung der Nutzer in ihrem natürlichen Arbeitsumfeld

💡 Wertdefinition und Lösungskonzeption

•

Value Proposition Design: Klare Definition des Wertangebots für verschiedene Nutzergruppen

•

Opportunity Sizing: Quantifizierung des potentiellen Nutzens und Geschäftswerts

•

Solution Ideation: Kreative Entwicklung möglicher Lösungsansätze

•

Concept Testing: Frühzeitige Validierung von Lösungsideen mit Nutzern

•

Prioritization Frameworks: Bewertung und Auswahl der vielversprechendsten Ansätze

•

Minimum Viable Data Product Definition: Bestimmung der kernwertschaffenden Funktionen

🛠 ️ Nutzerzentrierte Entwicklung

•

Co-Creation Workshops: Gemeinsame.

Wie gestaltet man erfolgreiche Geschäftsmodelle für Datenprodukte?

Die Entwicklung tragfähiger Geschäftsmodelle ist entscheidend für den langfristigen Erfolg von Datenprodukten. Im Vergleich zu traditionellen Produkten bieten Datenprodukte einzigartige Möglichkeiten für innovative Monetarisierungsansätze, die über klassische Lizenz- oder Abo-Modelle hinausgehen.

💰 Monetarisierungsstrategien für Datenprodukte

•

Subscription-Modelle: Wiederkehrende Zahlungen für kontinuierlichen Zugang und Updates

•

Tiered Pricing: Gestaffelte Preisstrukturen mit unterschiedlichen Funktionsumfängen

•

Usage-Based Pricing: Abrechnung nach tatsächlicher Nutzung (API-Calls, Datenvolumen, etc.)

•

Outcome-Based Pricing: Kopplung der Kosten an erreichte Ergebnisse oder Einsparungen

•

Freemium-Modelle: Kostenlose Basisversion mit kostenpflichtigen Premium-Funktionen

•

Data-as-a-Service: Bereitstellung aufbereiteter, qualitätsgesicherter Datensätze

•

Insight-as-a-Service: Verkauf von Analysen, Erkenntnissen und Prognosen

🌐 Wertschöpfungsmodelle und Positionierung

•

Data Enrichment: Anreicherung bestehender Daten mit zusätzlichen Informationen

•

Benchmarking: Ermöglichung von Vergleichen mit relevanten Markt- oder Branchendaten

•

Decision Support: Unterstützung datenbasierter Entscheidungsprozesse

•

Automation Enablement: Befähigung zur Automatisierung durch prädiktive Modelle

•

Risk Reduction: Minimierung von Geschäftsrisiken durch verbesserte Transparenz

•

Opportunity Discovery: Identifikation neuer Geschäftschancen durch Datenanalyse

•

Efficiency Improvement: Steigerung operativer Effizienz durch Datennutzung

🤝 Markteintrittstrategien und Vertriebs-Frameworks

•

Target Vertical Focus:.

Wie misst und steigert man die Qualität von Datenprodukten?

Die Messung und kontinuierliche Steigerung der Qualität von Datenprodukten ist entscheidend für deren langfristigen Erfolg. Datenprodukte erfordern dabei einen mehrdimensionalen Qualitätsansatz, der sowohl technische als auch nutzerbezogene Aspekte umfasst.

📊 Kerndimensionen der Datenproduktqualität

•

Datenqualität: Genauigkeit, Vollständigkeit, Aktualität und Konsistenz der Daten

•

Algorithmusqualität: Präzision, Robustheit und Verallgemeinerungsfähigkeit der Modelle

•

UX-Qualität: Benutzerfreundlichkeit, Zugänglichkeit und Verständlichkeit

•

Performance: Reaktionszeit, Durchsatz und Skalierbarkeit

•

Zuverlässigkeit: Stabilität, Fehlertoleranz und Ausfallsicherheit

•

Business Value: Tatsächlicher Geschäftsnutzen und Problembewältigung

•

Ethical Quality: Fairness, Transparenz und verantwortungsvolle Nutzung

🧪 Qualitätsmessung und Metriken

•

Data Quality Metrics: Messwerte für verschiedene Datenqualitätsdimensionen

•

Model Performance Metrics: Precision, Recall, F1-Score, AUC-ROC, etc.

Wie gelingt der Übergang vom Prototyp zum skalierbaren Datenprodukt?

Der Übergang vom Prototyp zum skalierbaren Datenprodukt ist eine kritische Phase, die über den langfristigen Erfolg entscheidet. Dieser Schritt erfordert eine sorgfältige Planung und systematische Herangehensweise, um die vielfältigen Herausforderungen zu bewältigen.

🔍 Validierung des Produkt-Markt-Fits

•

Success Metrics Review: Überprüfung der Erfolgskriterien aus der Prototypphase

•

Extended User Testing: Erweiterte Nutzertests mit breiterer Zielgruppe

•

Value Proposition Validation: Bestätigung des Wertbeitrags in realen Szenarien

•

Feedback Analysis: Strukturierte Auswertung aller Nutzerrückmeldungen

•

Competitive Positioning: Detaillierter Vergleich mit Wettbewerbsangeboten

•

Market Sizing Refinement: Präzisierung der Marktpotentialanalyse

🏗 ️ Technische Skalierung

•

Technical Debt Assessment: Bewertung und Priorisierung technischer Altlasten

•

Architecture Refinement: Überarbeitung für verbesserte Skalierbarkeit und Robustheit

•

Infrastructure Automation: Automatisierung von Bereitstellung und Betrieb

•

Performance Optimization: Identifikation und Beseitigung von Engpässen

•

Resource Sizing: Anpassung der Ressourcenzuweisung für erwartetes Wachstum

•

Caching Strategies: Implementierung effektiver Zwischenspeichermechanismen

📊 Daten- und Modellskalierung

•

Data Pipeline Industrialization: Professionalisierung der Datenflussprozesse

•

Model Retraining Automation: Automatisierte Aktualisierung von ML-Modellen

•

Data Volume Testing: Validierung mit realistischen Datenmengen.

Wie stellt man die nachhaltige Weiterentwicklung von Datenprodukten sicher?

Die nachhaltige Weiterentwicklung von Datenprodukten nach dem initialen Launch ist entscheidend für langfristigen Erfolg. Ein strukturierter Ansatz für kontinuierliche Verbesserung und Evolution stellt sicher, dass das Produkt relevant bleibt und seinen Wertbeitrag steigert.

🔄 Kontinuierliche Innovation und Evolution

•

Innovation Frameworks: Strukturierte Ansätze zur systematischen Innovation

•

Feature Experimentation: Kontrollierte Experimente mit neuen Funktionalitäten

•

Data-Driven Roadmapping: Priorisierung basierend auf Nutzungsdaten und Feedback

•

Innovation Sprints: Gezielte Zeiträume für experimentelle Entwicklung

•

Cross-Industry Inspiration: Transfer erfolgreicher Konzepte aus anderen Branchen

•

Emerging Technology Integration: Frühzeitige Adoption relevanter neuer Technologien

📊 Daten- und Modellverbesserung

•

Continuous Model Improvement: Laufende Optimierung analytischer Modelle

•

Data Enrichment Strategy: Systematische Anreicherung mit neuen Datenquellen

•

Feature Evolution: Weiterentwicklung relevanter Merkmale und Features

•

Algorithmic Refresh Cycles: Regelmäßige Überprüfung und Aktualisierung von Algorithmen

•

Feedback Loop Integration: Nutzung von Nutzerrückmeldungen zur Modellverbesserung

•

Advanced Analytics Adoption: Integration fortschrittlicher Analysemethoden

👥 Nutzer- und Community-Entwicklung

•

User Engagement Programs: Initiativen zur aktiven Nutzereinbindung

•

Community Building: Aufbau einer engagierten Nutzergemeinschaft

•

Beta.

Erfolgsgeschichten

Entdecken Sie, wie wir Unternehmen bei ihrer digitalen Transformation unterstützen

Generative KI in der Fertigung

Bosch

KI-Prozessoptimierung für bessere Produktionseffizienz

Fallstudie

Ergebnisse

Reduzierung der Implementierungszeit von AI-Anwendungen auf wenige Wochen

Verbesserung der Produktqualität durch frühzeitige Fehlererkennung

Steigerung der Effizienz in der Fertigung durch reduzierte Downtime

AI Automatisierung in der Produktion

Festo

Intelligente Vernetzung für zukunftsfähige Produktionssysteme

Fallstudie

Ergebnisse

Verbesserung der Produktionsgeschwindigkeit und Flexibilität

Reduzierung der Herstellungskosten durch effizientere Ressourcennutzung

Erhöhung der Kundenzufriedenheit durch personalisierte Produkte

KI-gestützte Fertigungsoptimierung

Siemens

Smarte Fertigungslösungen für maximale Wertschöpfung

Fallstudie

Ergebnisse

Erhebliche Steigerung der Produktionsleistung

Reduzierung von Downtime und Produktionskosten

Verbesserung der Nachhaltigkeit durch effizientere Ressourcennutzung

Digitalisierung im Stahlhandel

Klöckner & Co

Digitalisierung im Stahlhandel

Fallstudie

Ergebnisse

Über 2 Milliarden Euro Umsatz jährlich über digitale Kanäle

Ziel, bis 2022 60% des Umsatzes online zu erzielen

Verbesserung der Kundenzufriedenheit durch automatisierte Prozesse

Lassen Sie uns

Zusammenarbeiten!

Ist Ihr Unternehmen bereit für den nächsten Schritt in die digitale Zukunft? Kontaktieren Sie uns für eine persönliche Beratung.

Ihr strategischer Erfolg beginnt hier

Unsere Kunden vertrauen auf unsere Expertise in digitaler Transformation, Compliance und Risikomanagement

Bereit für den nächsten Schritt?

Vereinbaren Sie jetzt ein strategisches Beratungsgespräch mit unseren Experten

30 Minuten • Unverbindlich • Sofort verfügbar

Zur optimalen Vorbereitung Ihres Strategiegesprächs:

Ihre strategischen Ziele und Herausforderungen

Gewünschte Geschäftsergebnisse und ROI-Erwartungen

Aktuelle Compliance- und Risikosituation

Stakeholder und Entscheidungsträger im Projekt

Bevorzugen Sie direkten Kontakt?

Direkte Hotline für Entscheidungsträger

Strategische Anfragen per E-Mail

Detaillierte Projektanfrage

Für komplexe Anfragen oder wenn Sie spezifische Informationen vorab übermitteln möchten